In Kassel findet im Rahmen der Jahrestagung der Gesellschaft für Informatik in dieser Woche auch die 42. Deutsche Konferenz über Künstliche Intelligenz statt. Zum Auftakt der Konferenz ging es am Dienstag um KI-Systeme für das Militär.

Am spektakulärsten setzen die Militärs Systeme mit Künstlicher Intelligenz bei den autonomen Waffensystemen ein, aber auch in der sogenannten Lagebeurteilung: Mit ihrer Hilfe sollen Konflikte frühzeitig erkannt, bewertet und entsprechende militärische Strategien vorgeschlagen werden. Systeme für den schnellen Gegenschlag sollen erkennen, ob ein feindlicher Raketenangriff droht, und dann rascher als ein menschlicher Entscheidungsträger entsprechende Vergeltungsschläge vorbereiten und ausführen.

Schwierige Definition autonomer Waffen

Der angebliche Drohnenangriff auf eine Ölraffinerie in Saudi-Arabien soll mit autonomen Drohnen ausgeführt worden sein. KI-Experten äußern sich diesbezüglich sehr zurückhaltend. Das liegt auch daran, dass Drohnen dieser Art von den Militärs nicht als autonome Waffen eingeschätzt werden, sondern nur als teilautonom. So sieht die israelische Regierung beispielsweise ihre Harpy-Drohne nicht als autonomes Waffensystem: Diese wertet Funksignale aus, kann auf dieser Basis eine feindliche Radaranlage oder eine Ölraffinerie erkennen und diese selbstständig zerstören. Dafür muss aber der Angriffsmodus vor dem Raketenstart von einem Menschen freigeschaltet werden. Solche Drohnen sind mit Assistenzsystemen ausgestattet und können auch selbstständig ihr Ziel erkennen, aber ob sie als autonome Waffen gelten, ist umstritten.

Experten lehnen KI-Systeme im Militär ab

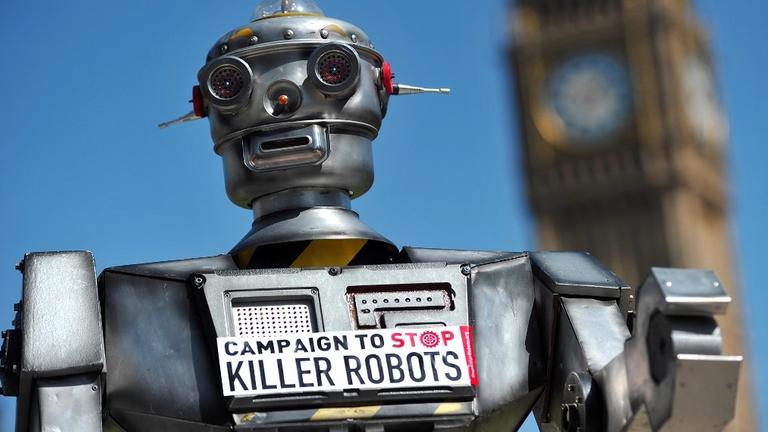

Für die in Kassel versammelten KI-Wissenschaftler ist diese Unterscheidung allerdings nicht wichtig: Mustererkennung, maschinelles Lernen und Prognosen aufgrund signifikanter statistischer Zusammenhänge seien die gängigen Techniken in der Künstlichen Intelligenz. Und wenn die in militärischen Zusammenhängen eingesetzt werden, könne das zu einer Destabilisierung der internationalen Beziehungen führen. Und dazu, dass sich ein Konflikt verselbstständige. Deshalb lehnen die KI-Wissenschaftler den Einsatz von KI-Systemen in militärischen Zusammenhängen ab. Professor Hannes Federrath, Präsident der Gesellschaft für Informatik, weist deutlich darauf hin, dass die ethischen Leitlinien der Gesellschaft für Informatik eine solche Ablehnung stützen. Dennoch lasse es sich nicht mehr rückgängig machen, dass in Waffensystemen auch KI enthalten ist. Deshalb sei eine internationale Regulierung der KI-Waffensysteme so wichtig. Doch mit dem derzeitigen Stand sind die KI-Wissenschaftler unzufrieden: Bisher haben nur 26 Staaten einem Verbot autonomer Waffensysteme zugestimmt. China, die USA, Russland, Israel und Indien sind gegen ein Verbot. Deutschland hat sich bisher nicht für ein solches Verbot ausgesprochen.

Gefahr eines automatisierten Vergeltungsschlags

In der Bundeswehr werden offiziell nur teilautonome Waffensysteme eingesetzt. Beim Gebirgsjägerbataillon 231 der Bundeswehr sichert ein autonomes Fahrzeug den Gebirgsjägerzug. Bei Feindkontakt erkennt das Fahrzeug die Position der gegnerischen Schützen und fordert Drohnen an. Allerdings soll bei solchen Konzepten immer noch ein Gruppenführer den Oberbefehl über die Waffensysteme haben. In jedem autonomen Waffensystem ist ein KI-System für die Lagebeurteilung implementiert, das die gegnerischen Kräfte anhand dieser Rohdaten einschätzen und bekämpfen kann. Bisher werden diese Rohdaten noch im digitalen zentralen Gefechtsstand ausgewertet. Das Lagesystem unterbreitet dann Handlungsempfehlungen, die ein Offizier noch freigeben muss, damit ein militärischer Befehl daraus wird. Informatiker sehen die große Gefahr, dass ein Lagesystem unter dem Druck der Verhältnisse automatisiert einen Vergeltungsschlag auslösen könnte.