"Die Internet Engineering Task Force kümmert sich weniger um die politischen Aspekte, wir konzentrieren uns auf die technischen Aspekte der Internet-Entwicklung. So kümmern wir uns darum, dass Kommunikation von einem zum anderen Ende geschützt werden kann. Das ist wichtig für die künftige Offenheit des Internet."

Manfred Kloiber: Das sagte Jari Arkko, der Vorsitzende der Internet Engineering Task Force. Um die Offenheit des Internet wurde ganz intensiv diskutiert auf dem 96. Meeting der Internet-Ingenieure diese Woche in Berlin. Netzsperren in der Türkei, das drohende Ende der Netzneutralität in Westeuropa, die zunehmende militärische Nutzung des Netzes mit den entsprechenden Planungen für den Cyberkrieg waren natürlich Themen, denen sich die Internet-Ingenieure nicht entziehen konnten.

Aber damit offen im Netz kommuniziert werden kann, müssen die Nutzer auch darauf vertrauen können, dass nur diejenigen eine vertrauliche Mitteilung lesen, für die diese Mitteilung auch wirklich gedacht ist.

Wie kann der Nutzer sicher sein, dass er nicht ausspioniert wird?

Peter Welchering: Und deshalb ist auch in dieser Woche sehr ausführlich darüber gesprochen worden, wie Verschlüsselung und Anonymisierung so in die Internet-Protokolle eingebaut werden können, dass der Benutzer auch ohne großartige technische Kenntnisse damit umgehen kann, also sich unerkannt im Netz bewegen kann und sicher sein kann, dass weder er noch seine Bekannten im Netz von irgendjemandem belauscht oder ausspioniert werden.

Die meisten Regierungen hingegen fordern, genau in solche Anonymisierungstools Hintertüren einzubauen, so dass nämlich Sicherheitsbehörden die Netzkommunikation überwachen können. In den Sonntagsreden verteidigen alle Politiker hierzulande solche sichere Kommunikation. Die Staatssekretärin im Wirtschaftsministerium, Brigitte Zypries, sagte denn vor ihrer Rede auf dem IETF-Meeting auch in das Deutschlandfunk-Mikrofon:

"Es gibt in Deutschland keine Hintertür für die Sicherheitsbehörden, und das soll auch so bleiben, wie Bundesminister de Maizière ja kürzlich auch verkündet hat. Das ist sozusagen in Deutschland State of the Art."

Welchering: In ihrer Rede wies die Staatssekretärin dann allerdings darauf hin, dass die Sicherheitsbehörden handlungsfähig bleiben müssten. Und das setze nun mal eine gewisse Kontrolle des Netzes voraus.

Kloiber: Ja, und genau deshalb glauben viele Netznutzer, auch in den westlichen Demokratien, nicht mehr, dass das Netz integer ist und sie sich dort unbeobachtet und sicher bewegen können. Die Internet-Ingenieure machen daraus auch keinen Hehl mehr und sagen ganz klar: Es müssen endlich Protokolle her, die diese Integrität wieder sichern.

Welchering: In der Arbeitsgruppe zur Transportsicherheit haben die Teilnehmer am IETF-Meeting drei Stunden lang ganz intensiv darüber diskutiert. Eine Menge zusätzlicher Sicherheitsmaßnahmen auf fast allen Protokollebenen ist dabei beschlossen worden. Und diese Sicherheitsmaßnahmen sollen enorm zügig umgesetzt werden. Nur so könne man das Vertrauen der Netznutzer rechtfertigen, meint Martin Thomson von der Mozilla Foundation:

"Das Vertrauen der Nutzer zu erhalten, das ist eines der wichtigsten Dinge. Der Grad der Transparenz von Entscheidungen hier ist sehr hoch. Akademische Experten und externe Sachverständige werden eng eingebunden. Bei so einem wichtigen Protokoll ist das eine kritische Angelegenheit. Und das ist das Beste, um das Vertrauen der Nutzer zu erhalten. Da machen wir eine gute Arbeit."

Googles Quic will gegen bewährte Netzprotokolle antreten

Kloiber: Die Weiterentwicklung der Protokolle, um mehr Sicherheit, mehr Privatheit garantieren zu können, war denn auch in mindestens 40 Veranstaltungen das zentrale Thema. Mit fast 400 Teilnehmern platzte die Session zum möglichen neuen Protokollstandard QUIC im Berliner Intercontinental Hotel regelrecht aus allen Nähten.

Um QUIC gibt es deshalb so viel Wirbel, weil es als Ersatz für das zentrale Herzstück der Internet-Protokoll-Familie antritt, nämlich für das Transport Control Protocol TCP. 2013 hat Google QUIC als Alternative vorgeschlagen, und die soll nun als Internet-Standard verabschiedet werden. Dr. Lars Eggert, einer der Vorsitzenden der QUIC -Arbeitsgruppe in der IETF, hat mir das neue Protokoll erklärt:

"Also QUIC macht es zum Beispiel möglich, für Verbindungen zwischen Rechnern einen schnelleren Aufbau der Verbindungen zustande zu bringen, wenn man sich in der Vergangenheit schon einmal unterhalten hat. Also wenn sich Ihr Mobiltelefon und der Google-Server das erste Mal unterhalten, dann wird ein etwas längerer Handshake ausgehandelt, wo zum Beispiel Krypto-Schlüssel ausgetauscht werden.

Aber wenn sie dann zwei Minuten später wieder mit dem Server sprechen, dann erinnert der sich sozusagen an sie und man kann ein Teil dieses Handshakes dadurch umgehen und gewinnt dadurch Latenzzeiten. Und zusätzlich verschlüsselt QUIC auch Informationen, die dem Datentransport im Netz dienen, die TCP/IP nicht verschlüsselt.

Oder, wenn sie nicht verschlüsselt sind, dann werden sie zumindest so authentifiziert, dass auf der Netzseite diese Informationen, diese Paketheader nicht mehr geändert werden können, ohne dass es den Endsystemen auffällt. Und das bringt einen kleinen Konfliktpunkt, weil Operator Verkehrsmanagement in Netzen bisher gerne so gemacht haben, dass sie halt auf diese Headerdaten, die in den Paketen drinnen stecken, zugegriffen haben.

Daraus haben sie erst einmal Informationen über die Verkehrsflüsse abgeschöpft und haben dann auch noch die Möglichkeit, dadurch dass sie diese Header verändern konnten, den Datenfluss zu steuern. Und das macht gerade den Mobilfunkbetreibern Sorgen, weil da oft die Kapazitäten schon sehr eng sind."

Welchering: Quic blieb allerdings heftig umstritten auf dem IETF-Meeting. Das muss man sehen. Viele Internet-Ingenieure misstrauen Google hier einfach und argwöhnen, dass Google hier einen Protokollstandrad durchdrücken will, um seine ohnehin schon große Marktmacht einfach weiter auszubauen.

Kloiber: Dieses Misstrauen wirkt sich allerdings durchaus produktiv aus. Denn es war immer wieder zu hören, dass die entsprechenden Arbeitsgruppen in der IETF die Arbeit am Protokollstandard TLS 1.3 und an TCPCrypt beschleunigen müssen, damit Google hier mit Quic nicht einfach einen neuen Standard diktiert.

Welchering: Ja und insofern bleibt also jede Menge Wettbewerb. Und nicht nur diese Diskussion um Quic zeigt deutlich, dass der Einfluss der Unternehmen in der IETF über die Jahre erheblich abgenommen hat. Tobias Gondrom, Vorsitzender einer IETF-Arbeitsgruppe, fasst das so zusammen:

"Das ist eines der am meisten faszinierenden Elemente. Die IETF ist eine Standardisierungsorganisation, wo Individuen zusammenkommen, nicht Unternehmen, Individuen, um die beste technische Lösung zu finden. Und Sie haben die beiden Grundprinzipien rough consensus und running code.

Es gibt hier keine Abstimmung von Unternehmen oder so etwas, was jetzt politisch vielleicht interessant wäre. Nein, das sind technische Experten, die miteinander diskutieren: Was ist das Problem, und was ist die Lösung?"

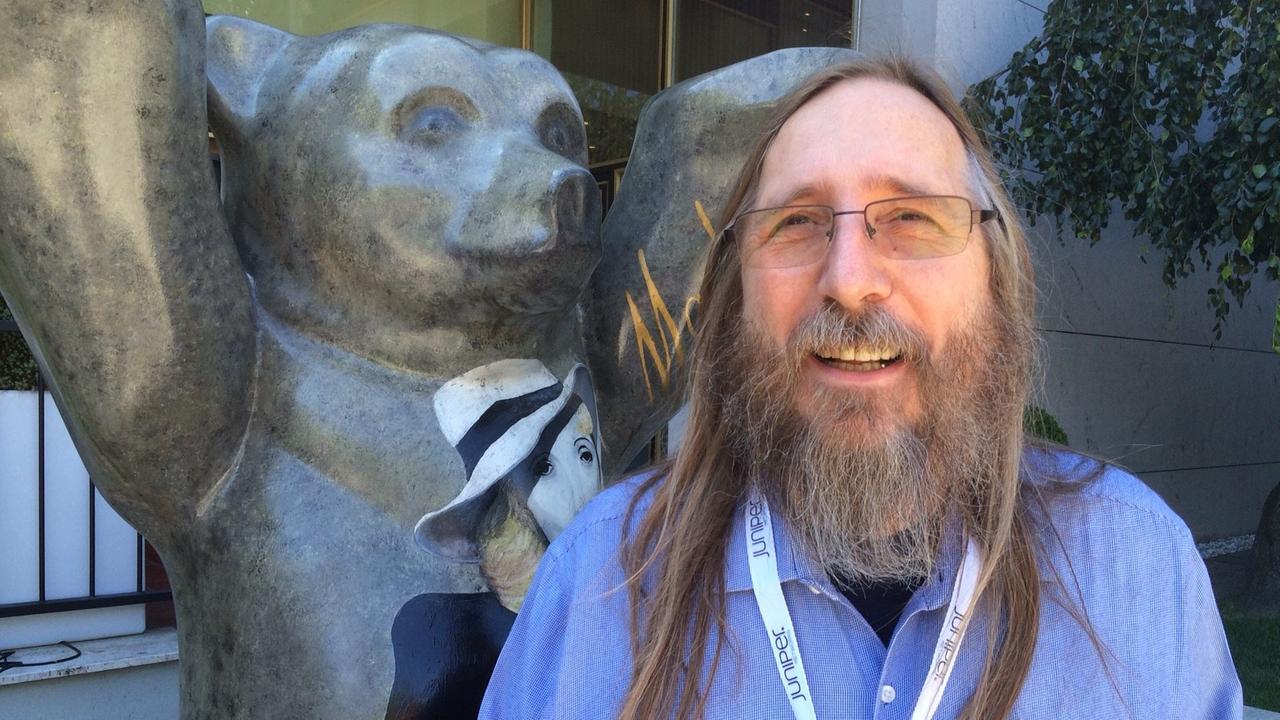

Kloiber: Allerdings sind das eben technische Experten, die auch die politischen Implikationen ihrer Arbeit sehr stark bedenken. Hans-Peter Dittler von der Internet Society, man kann ihn getrost auch einen Netzwerkguru der ersten Stunde nennen, sieht hier allerdings auch einen Bewusstseinswandel seiner Kollegen. Seit den Enthüllungen von Edward Snowden seien viele von ihnen deutlich sensibilisierter:

"Internet-Protokolle, die bei der IETF standardisiert werden, müssen seit langem einen sogenannten Security-Teil einhalten. Also man muss sich Gedanken über die Sicherheit machen, das war schon vor Snowden so. Aber nach Snowden gab es denn auch noch mal ein Paper von der IAB, vom Internet Architecture Board, was ganz klar sagte, Sicherheit darf nicht einfach als Placebo auf einer viertel Seite abgehandelt werden in einem Standard.

Sondern Sicherheit, Verschlüsselung, Schutz der eigenen Daten muss ein zentraler Teil der Überlegung bei der Standardisierung sein. Und das sieht man. Bei Standards, die jetzt nach und nach erscheinen, ist das etwas, was einfach berücksichtigt und behandelt wird."

Standards für die Abwehr von Überlastangriffen

Welchering: Solche Sicherheitskonzepte haben natürlich auch mehrere Aspekte. Angriffe auf kritische Infrastruktur, Überlastangriffe, bei denen mit Abertausenden von Datenpäckchen auf einen Rechner geschossen wird, solange, bis er in die Knie geht aufgrund der Last der Datenpäckchen haben die Internet-ingenieure auf ihrem 96. Meeting in Berlin stärker als zuvor beschäftigt.

Inzwischen ist eine eigene Arbeitsgruppe eingesetzt worden, die sich damit beschäftigt, Überlastangriffe, auch Denial-of-Service-Attacken genannt, zu erkennen und abzuwehren. Und die in dieser Working Group tätigen Konferenzteilnehmer, die hatten eine regelrechte Mammutarbeit zu bewältigen. Denn es mussten gleich sehr viele unterschiedliche Standards definiert und verabschiedet werden.

Tobias Gondrom sitzt der Arbeitsgruppe vor, die sich in der IETF mit Überlastangriffen und wie man ihnen begegnet beschäftigt. Und er beschreibt die Situation so:

"Die Angreifer haben in der Vergangenheit erst durch einzelne Angriffe versucht, Denial of Service zu erzeugen. Dann haben sie sich drauf geeinigt, oh, oh okay, vielleicht braucht man viele Angriffsrechner, sog Bot-Netze, möglicherweise mit 2000, 4000, tausenden von Angriffsrechnern. Das heißt die sind praktisch in die Cloud gegangen. Und jetzt ist die Frage, können wir das umdrehen? Können die Verteidiger auch in die Cloud gehen und entsprechende Kapazitäten elastisch bereitstellen?"

Kloiber: Wenn verteilte Überlastangriffe aus der Cloud heraus abgewehrt werden sollen, dann müssen Standards her, die die Zusammenarbeit der einzelnen Verteidigungselemente von ganz verschiedenen Herstellern ermöglichen. Und da haben ja bisher die Hersteller in diesem Bereich eifersüchtig über ihre proprietären Standards gewacht. Sie befürchteten, dass sie Kunden und Marktanteile verlieren, wenn ihre Abwehralgorithmen bekannt werden würden.

Welchering: Na ja, Open Source herrscht in diesem Bereich eben nicht gerade vor, aber die Analyse von Datenpäckchen, die Filterprozeduren, das Umleiten oder ableiten von solchen Angriffs-Datenpäckchen, dafür immerhin gibt es offene Standards. Und die hat die IETF eingeführt und entwickelt sie auch weiter. Und die dürften zukünftig auch kritische Infrastrukturen doch ein Stück sicherer machen, so dass nicht einfach zum Beispiel die Bargeldversorgung über Tage hinweg nicht funktioniert, weil Angreifer mit ihren Überlastangriffen die Bankserver schlicht lahmgelegt haben.

Kloiber: Um mehr Sicherheit geht es auch bei der anstehenden Neusignierung des zentralen Adress- und Straßenverzeichnisses im Internet. Wann immer eine Webadresse, wie etwa www.deutschlandfunk.de aufgelöst werden soll, damit die Anfrage eines Nutzers an diese Webadresse auch an die richtige Internet-Protokolladresse weitergegeben wird, muss die Antwort des Domain Name Servers abgesichert werden.

Welchering: Diese Antworten des Domain Name Servers werden durch Krypto-Signaturen überprüft. Und das hat sich ja während der vergangenen fünf Jahre als ziemlich gutes Mittel gegen Phishing-Angriffe und auch gegen das Umleiten von Anfragen auf nachgebaute Fake-Server erwiesen. Also die Sicherheit, ist durch die Signierung erhöht worden. Bisher ist auch noch kein Schlüssel wirklich kompromittiert worden. Aber für diesen Notfall will die ICANN gerüstet sein. Falls dann doch mal ein kompromittierter Schlüssel ausgetauscht werden müsste, braucht die ICANN die jetzt geplante Neusignierung. Und die soll jetzt zügig in Angriff genommen werden. Robert Conrad, Chief Technology Officer der ICANN erläutert das so:

"Es ist generell eine gute Übung, kryptografisches Material zu erneuern, ähnlich wie man das Passwort ändern sollte. Wir erneuern die Schlüssel, um künftig Schlüssel komplett austauschen zu können."

Kloiber: Also eine reine Vorsorgemaßnahme. Und deshalb hat sich die ICANN dafür auch einen ziemlich entspannten Zeitplan überlegt. Und den hat Matt Larson von der Internet-Verwaltungsagentur so beschrieben:

"Wir erzeugen die Schlüssel am 26. Oktober 2016. Wir veröffentlichen sie dann am 11. Juli 2017. Und die eigentliche Schlüsselerneuerung findet dann am 11. Oktober 2017 statt."

Welchering: Es gab ja während der vergangenen Monate schon einige Unkenrufe, dass es dann schon zu Problemen bei Anfragen an das Domain Name System führen könnte, wenn an irgendeiner Stelle diese Neusignierung stockt oder nicht so klappt. Doch bei dem Zeitplan, den die ICANN vorgelegt hat, sollte selbst im Fall von irgendwelchen Störungen genügend Spielraum für die Störungsbeseitigung sein. Allerdings gab es auch die Forderung, mit dieser Neusignierung zu warten. Nämlich so lange zu warten, bis sich Version 6 des Internet-Protokolls wirklich durchgesetzt habe und tatsächlich die alte Version 4 endlich abgelöst hätte. Das wurde aber als schwierig eingeschätzt, weil Version 4 des Internet-Protokolls einfach nicht sterben will, sprich viele Firmen wollen einfach nicht auf Version 6 umsteigen.

Kloiber: Ja und da gab es noch vom letzten Meeting im April in Buenos Aires einen ganz pfiffigen Vorschlag, der dann in Berlin weiter diskutiert wurde. Der amerikanische Netzwerkspezialist Lee Howard, übrigens bei einem großen Kabelanbieter aktiv, der fordert, die IETF solle Version 4 jetzt endlich historisch erklären, um so das alte Internet Protokoll aus dem Bewusstsein zu verdrängen. Schließlich sei auch der Faustkeil einmal eine gute Technologie gewesen, aber seine Zeit sein nun eindeutig vorüber.

Welchering: Der australische Netzwerk-Ingenieur Geoff Houston hielt dagegen. Sein Argument: Eine Technologie, mit der mehr als 10 Milliarden PCs, Smartphones, PCs oder Tablets kommunizieren, könne man nicht einfach für tot erklären, das sei doch albern. Und:

"IPv4 ist einfach und leicht verfügbar. Jeder nutzt es und wird es weiter nutzen, bis die Adressen verbraucht sind. In der IETF wird darüber diskutiert, wie wir damit umgehen sollen. Einige glauben, dass es ein Kommunikationsproblem sei, ein Problem der Public Relations. Wir müssten nur starke Signale an die Industrie und an die Investoren senden.

Andere meinen, es sei ein Problem des Investments, der Kosten also. Das Beste, was wir tun können, ist aufklären. IP Version 4 für historisch zu erklären, würde das Problem nicht an der Wurzel packen."

Welchering: Die Frage ist dann allerdings, ob eine solche Erklärung ausreicht, um die Unternehmen wirklich zu motivieren, auf Version 6 umzusteigen.

Kloiber: Ganz sicher nicht, denn viele Firmen verspüren gar keinen Druck dazu und warten lieber ab, bauen die IPv4-Infrastruktur solange aus, bis es kracht. Viele Netzbetreiber wie etwa Kabel Deutschland oder die Deutsche Telekom würden lieber frühzeitig IPv6 setzen, damit sie nicht irgendwann ins Hintertreffen gerieten, sagt Houston. Und so sei es einfach eine Frage von Wettbewerb, wann IPv4 sozusagen von selbst sterbe.

Welchering: Dass Version 4 des Internet-Protokolls einfach so von selbst sterbe, erwarten tatsächlich viele Experten. Aber der Zeitpunkt, an dem das passiert sein wird, der wird sehr, sehr unterschiedlich eingeschätzt. Und auch über die Ursachen, die dazu führen, dass Version 4 außer Dienst gestellt wird, gehen die Meinungen weit auseinander.

So wurde denn auch in einer Arbeitgruppe intensiv darüber diskutiert, wie Protokolle weiterentwickelt werden müssen, die ganze Gruppen von Geräten mit einem verschlüsselten Befehl steuern. Soll dafür Version 4 noch insofern weiterentwickelt werden, dass zwar keine neuen Standards mehr entstehen, aber dass bekannt werdende Sicherheitsprobleme ausgeräumt werden. Und da meinen die Internet-Ingenieure mehrheitlich, Sicherheitsprobleme müssen immer beseitigt werden.

Kloiber: Ein spannendes Sicherheitsproblem bei solchen Gruppenaufrufen ist am Beispiel einer Lichtanlage in einem Haus diskutiert worden. Dr. Ludwig Seitz vom Sicherheitslabor des SICS-Forschungsinstituts für angewandte Informations- und Kommunikationstechnologie in Schweden erklärt das Problem so:

"Wenn Sie eine Lichtanlage haben, die aus mehreren Lampen besteht und Sie schicken ein Kommando, diese Lichter anzumachen und dieses Kommando kommt verzögert an oder wird verzögert bearbeitet, dann kriegen Sie einen Welleneffekt. Und die Lichthersteller sagen uns, das wird von den Kunden als sehr unangenehm empfunden. Deswegen ist es wichtig, dass man garantieren kann, dass ein Kommando innerhalb von einer relativ kurzen Zeit bearbeitet wird, so dass Sie eben nicht diese Welleneffekte kriegen. Und deswegen muss eben der Sicherheitsmechanismus so sein, dass es möglich ist für ein solches Gerät mit sehr geringen Hardwareressourcen diesen Sicherheitsmechanismus zu bearbeiten in der gegebenen Zeit, ohne dass es eben diese Verzögerungen gibt, die dann die ungewünschten Effekte erzeugen."

Welchering: Bisher wurde einfach eine Art Gruppenzertifikat für alle Server ausgestellt, die zum Beispiel dann mit den Lampen einer solchen Lichtanlage zu tun haben. Aber solche Gruppenzertifikate sind problematisch, denn die können missbraucht werden. Das ist bei Lichtanlagen in Wohnhäusern jetzt nicht so schlimm. Wenn sich dort jemand mit einem solchen Gruppenzertifikat Zugriff verschafft und - sagen wir - alle Lampen eines Hauses um Punkt 22:00 Uhr ausschaltet, ist das ärgerlich, aber nicht lebensgefährlich – normalerweise.

Bei Licht in einem Operationssaal sieht das anders aus. Und deshalb entwickeln die Internet-Ingenieure hier ein Sicherheitsprotokoll, das mit einzelnen Zertifikaten arbeitet, aber bei dieser Einzelzertifikatsbearbeitung dennoch ausreichend schnell ist.

Kloiber: Das gilt übrigens auch für Infrastrukturen wie Ampeln, die zunehmend über das Internet gesteuert werden. Die Störung solcher Infrastrukturen ist ja inzwischen Bestandteil einer jeden Cyberwar-Strategie der Militärs.

Welchering: Und obwohl Standesorganisationen von Computerwissenschaftlern weltweit solche Cyberangriffsszenarien der Militärs ablehnen, sind die Internet-ingenieure nicht blauäugig. Deshalb setzen sie auch nicht nur auf Aufrufe ihrer weltweiten Standesorganisationen, sich nicht an solchen Angriffsprojekten zu beteiligen, sondern wollen die Protokolle so sicher wie möglich machen, damit möglichst wenige Schwachstellen geboten werden.

Dabei wissen sie natürlich, dass auch diese Protokolle dem Dual Use unterliegen, wie jede Technik. Auch Einzelzertifikate können missbraucht und für Angriffszecke genutzt werden. Ausschließen kann man das nie, aber erschweren lässt sich der Missbrauch schon.

Kampf um die universellen Menschenrechte

Kloiber: Insgesamt unterliegt das Internet eben diesem Dual Use. Das gilt auch in Sachen Menschenrechte. Das Internet bietet Foren für Menschenrechtsaktivisten, die dort ihre Aktionen koordinieren und Informationen austauschen.

Welchering: So haben einige Teilnehmer am IEFT-Meeting kurzerhand die Initiative ergriffen und durch das Aufsetzen von Ersatzroutern in der Türkei gesperrte Wikileaks-Server für türkische Oppositionelle und kritische Journalisten zugänglich gemacht. Einige Internet-ingenieure helfen in Projekten, digitale Briekästen einzurichten, um Informationen über Menschenrechtsverstöße etwa in der Türkei auszutauschen.

Kloiber: Die Menschenrechte und ihre Charta sind auf dem IETF-Meeting natürlich auch Thema gewesen. Inzwischen hat sich eine Arbeitsgruppe in der Schwesterorganisation IRTF, der Internet Research Task Force zusammengefunden, die sich auf die Fahnen geschrieben hat, zu untersuchen, wie Internet-Technologien Menschenrechte schützen oder verletzten können. Niels ten Oever von der niederländischen NGO "Article 19" hat mir die Ziele dieser Arbeitsgruppe erklärt:

"Das Ziel unserer Arbeitsgruppe ist zu verstehen, welchen Einfluss Internet-Standards und Protokolle auf die universellen Menschenrechte haben. Und ob es sinnvoll ist, Richtlinien zu erstellen, die negative Auswirkungen verhindern sollen. Wir haben eine Checkliste entwickelt, die dem Protokoll-Entwickler helfen soll, die verschiedenen Blickwinkel auf ein Problem zu erkennen, welche Rechte betroffen sein könnten. Das Recht auf Bildung, das Recht auf freie Meinungsäußerung oder das auf Koalitionsfreiheit.

Wir geben konkrete Beispiele und Erklärungen und damit können die Entwickler dann ihre Entscheidungen dazu dokumentieren. Dadurch wird nachvollziehbar wie sie mit dieser Abwägung umgehen, schließlich können Rechte auch miteinander konkurrieren. Es sollte klar sein, welche Wahl getroffen wurde und warum."

Kloiber: Niels ten Oever war das von der niederländischen NGO "Article 19". Und das war auch unser Bericht von der 96. Tagung der Internet Engineering Task Force diese Woche in Berlin.