Das Foto, das Anas Modamani bei einem Selfie mit Angela Merkel zeigt, ging um die Welt: Zu sehen ist die deutsche Bundeskanzlerin eng neben dem syrischen Flüchtling, beide lächeln in das Smartphone von Modamani. Weltweit wurde die Aufnahme als Beleg der deutschen Willkommenskultur interpretiert. Als Bereitschaft Merkels, Flüchtlingen hierzulande Schutz und Obdach zu gewähren. Für den damals 18-Jährigen bedeutete das Selfie aber auch, dass er im Internet zur Zielscheibe fremdenfeindlicher Hetze wurde.

"Seither wird er immer wieder mit Straftaten oder Attentaten in Verbindung gebracht", sagt sein Anwalt Chan-Jo Jun in einem Video auf seiner Facebook-Seite.

"Zuletzt wurde behauptet, er sei einer der Attentäter, die im Dezember einen Obdachlosen in Berlin angezündet hätten. Vorher schon wurde behauptet, er wär einer der Bombenattentäter von Brüssel und jedes Mal, wenn etwas mit Flüchtlingen passiert, wird er quasi als Ikone, als Merkels Musterflüchtling vorgezeigt und ihm werden Straftaten untergeschoben."

Die Unterstellung, Modamani sei an dem Brandanschlag auf einen Obdachlosen in Berlin beteiligt gewesen, wurde bei Facebook gepostet und weiterverbreitet. Anwalt Jun hat Facebook deswegen verklagt und will wegen Verletzung des Persönlichkeitsrechts eine einstweilige Verfügung erwirken. Sein Mandant müsse sich die Verleumdungen nicht gefallen lassen und könne verlangen, dass das Online-Unternehmen die Fake News über ihn lösche und das Foto sperre, so der Anwalt. Am Montagverhandelt das Landgericht Würzburg über den Fall.

"Facebook tut sich ungewöhnlich schwer, deutsches Recht umzusetzen. Beispielsweise Verleumdungen oder Beleidigungen verstoßen gegen deutsches Recht, aber nicht gegen Gemeinschaftsstandards. Hier wird sich zeigen, ob deutsches Recht nun durchsetzbar sein wird. Oder ob, so wie manche Politiker es fordern, gesetzliche Änderungen notwendig sind, damit sich Facebook auch an deutsche Standards hält."

Auch andere Anwälte, die Medien und viele Internetnutzer erwarten das Würzburger Urteil mit Spannung. Denn der Verleumdungsfall von Anas Modamani steht beispielhaft für ein Problem, das die Öffentlichkeit seit einiger Zeit umtreibt: Es geht um die Frage nach dem richtigen Umgang mit Fake News.

Fake News, also Falschnachrichten und falsche Behauptungen, sind eigentlich so alt wie die Menschheit. Denn Lügengeschichten über andere wurden schon immer verbreitet. Neu an dem jetzigen Phänomen ist: Bei sozialen Netzwerken wie Facebook oder Twitter kann jeder Internetnutzer Inhalte posten und einem Millionenpublikum zur Verfügung stellen. Und diese im Grunde demokratische Entwicklung bringt zahlreiche Tücken mit sich, sagt Philipp Müller vom Institut für Publizistik an der Universität Mainz.

"Politische Richtungen, die vielleicht Propaganda unters Volk bringen wollen, die Unwahrheiten unters Volk bringen wollen, die haben es jetzt leichter, weil sie vorher eine Barriere passieren mussten, die der Journalist war. Der professionelle Journalist, der früher garantiert hat - oder zumindest im Rahmen seiner Möglichkeiten versucht hat - zu verhindern, dass Unwahres veröffentlicht wird, diese Barriere ist jetzt gefallen und damit kann jeder das online stellen und als Nachricht verbreiten, was er für richtig hält."

Auf diese Weise landen Lügen und Verleumdungen über Privatpersonen, über Flüchtlinge oder über Politiker auf den Smartphones der Nutzer. Volker Kauder, Fraktionsvorsitzender von CDU/CSU im Deutschen Bundestag, beschrieb die Situation bei einem Fachgespräch seiner Fraktion vor wenigen Tagen so:

"Gerade in den sozialen Medien, die sind zu einem Ort geworden, wo dem politischen Gegner jeden Tag unzählige Male die Ehre genommen werden soll. Es wird beleidigt, denunziert und verleumdet."

Nicht immer geht es dabei um politische Absichten. Zahlreiche Fake News wollen mit reißerischen Überschriften einfach nur Aufsehen erregen. Denn mit ihnen lässt sich sogar Geld verdienen, sagt Markus Beckedahl, Chefredakteur der Webseite Netzpolitik.org, der diese Entwicklung seit Längerem beobachtet:

"Ein Phänomen, das wir unter Fake News diskutieren, ist, dass es Geschäftemacher gibt, die erkannt haben, dass, wenn sie Märchen im Internet erzählen, zum Beispiel die Geschichte, der Papst unterstützt Donald Trump im US-Wahlkampf, dass es da sehr viele Anhänger vom Papst und Donald Trump gibt, die diese Nachricht teilen, um sie anderen nahezubringen, um andere auch noch zu mobilisieren. Dass damit eine Masse an Lesern geschaffen wird, die die notwendige Reichweite bringt, um Anzeigen wiederum einzublenden und zu verkaufen."

Eine Entwicklung, die vor der Bundestagswahl im September auch auf die deutsche Öffentlichkeit zurollen könnte. Das jedenfalls befürchtet Simon Hegelich, Professor für Political Data Science an der Technischen Universität München.

"Was wir im Moment sehr intensiv beobachten bei uns in München, es sieht so aus, als würden viele Fake-News-Seiten, die bisher Werbung für Trump gemacht haben, aber wo wir davon ausgehen, dass das gar nicht aus einem politischen Interesse heraus ist, sondern weil die festgestellt haben, dass man mit Trump-Werbung viele Leser auf seine Seite kriegt und Trump-Wähler viel Werbung anklicken, dass diese Seiten jetzt umschwenken und immer stärker die Bundeskanzlerin kritisieren."

Fake News können zur Verzerrung der Wahrnehmung führen

Empirische Studien - wie eine kürzlich von der Stanford-Universität vorgelegte - zeigen: Fake News beeinflussen die Wahlentscheidung der Bürgerinnen und Bürger nur in sehr wenigen Fällen. Ein Problem der Falschnachrichten sei jedoch: Sie könnten unsere Sicht auf die Welt beeinflussen und zu einer Verzerrung der Wahrnehmung führen, glaubt Hegelich:

"Dadurch passiert, dass wir in unserer grundlegenden Auffassung dessen, was wahr und falsch ist, irritiert werden. Weil normalerweise denken wir, wenn ich etwas einmal höre und es ist Schwachsinn, dann ist es Schwachsinn. Aber wenn ich es fünf Mal höre oder vielleicht 50 Mal, dann denke ich, naja, vielleicht ist ja trotzdem was dran."

Seit Wochen hat die Debatte um Fake News auch die Berliner Politik erfasst – wohl auch aus Sorge, dass Falschnachrichten, Lügen und Verleumdungen den Bundestagswahlkampf mitbestimmen könnten. Im Dezember sprach Innenminister Thomas de Maizière von der Einrichtung eines "Abwehrzentrums gegen Desinformation"* – eine Idee, die sein Ministerium mittlerweile wieder verworfen hat. Vielleicht weil Journalistenverbände befürchten, der Staat wolle Zensur ausüben. Untätig wollen die Politiker dennoch nicht bleiben. Fraktionsvorsitzender Kauder formulierte es kürzlich so:

"Das Recht muss auch in den sozialen Medien gelten. Das, was in der analogen Welt verboten ist, muss auch in der digitalen Welt verboten sein."

Diese Übertragung ist jedoch alles andere als einfach: Denn in der analogen, also körperlichen Welt, unterliegen die Medien Gesetzen und Regelungen, erklärt Rolf Schwartmann, Leiter der Forschungsstelle für Medienrecht an der Technischen Hochschule Köln.

"Der rechtliche Hintergrund von Hass, also diskreditierenden Meinungsäußerungen und Fake ist Artikel 5 des Grundgesetzes. Demnach ist die Meinungsäußerung frei und sie darf über Medien verbreitet werden. Zugleich sind aber ehrverletzende Meinungen nach der Meinungsäußerungsfreiheit verboten. Und dieses System ist durch das Bundesverfassungsgericht ausdifferenziert worden."

Das bedeutet: In Zweifelsfällen entscheiden die deutschen Gerichte, ob umstrittene Aussagen vom Recht auf Meinungsfreiheit gedeckt sind oder gegen andere Gesetze verstoßen.

Facebook, Twitter und Google operieren bislang in einer Regulierungslücke

Doch diese Regelungen - und das ist ein wesentliches Problem der aktuellen Debatte - beziehen sich nur auf die klassischen Medien wie Zeitungen, Fernsehen oder Hörfunk. Für Facebook, Twitter oder Google gelten sie nicht. Denn die US-Unternehmen produzieren die bei ihnen veröffentlichten Inhalte nicht selbst; sie sind deshalb keine Medien im herkömmlichen Sinne. Nur, was die sozialen Netzwerke sind und welche Verantwortung sie für die Inhalte auf ihren Seiten tragen, diese Frage sei immer noch ungeklärt, bedauert Rolf Schwartmann:

"Wir müssen uns die Frage stellen, wie können wir diesen freien und ungehemmten Meinungsprozess wirksam überprüfen und kontrollieren. Und von daher hat Facebook eine Rolle, die es unter Geltung der klassischen Medien nicht gab und damit muss man jetzt umgehen. Und da sind wir in einem Trial- und Error-Prozess und müssen uns auch erst einmal klar werden, was wollen wir."

Facebook, Twitter und Google operieren bislang in einer Regulierungslücke. Hinzu kommt eine Definitionsfrage, die den Umgang mit den Netzwerken zusätzlich erschwert. Denn die Online-Unternehmen verstehen sich als reine Plattformen, sie betrachten sich also als eine Art Schwarzes Brett, da nicht sie selbst, sondern ihre Nutzer die Inhalte erstellen.

Juristisch betrachtet fallen die Unternehmen damit unter das Telemediengesetz. Und das schreibt Twitter, Facebook und Co. keinerlei inhaltliche Verantwortung zu, sondern macht sie lediglich haftbar für verleumderische und volksverhetzende Inhalte auf ihren Seiten. Das heißt: Nutzer können bei Facebook oder Twitter alle möglichen Aussagen posten, etwa die, der nun deshalb in Würzburg klagende Syrer Anas Modamani sei an dem Brandanschlag auf einen Berliner Obdachlosen beteiligt gewesen. Löschen werden die Unternehmen solche Lügen nur dann, wenn sie per Gerichtsbeschluss dazu gezwungen werden. Eva Maria Kirschsieper, die Leiterin Public Policy von Facebook in Deutschland:

"Wenn ein Gericht in Deutschland entscheidet, dass eine bestimmte Aussage unzulässig ist und wir haben diesen Gerichtsbeschluss auf dem Tisch, können Sie die Minuten zählen, in denen dieser Inhalt von unserer Plattform verschwunden ist."

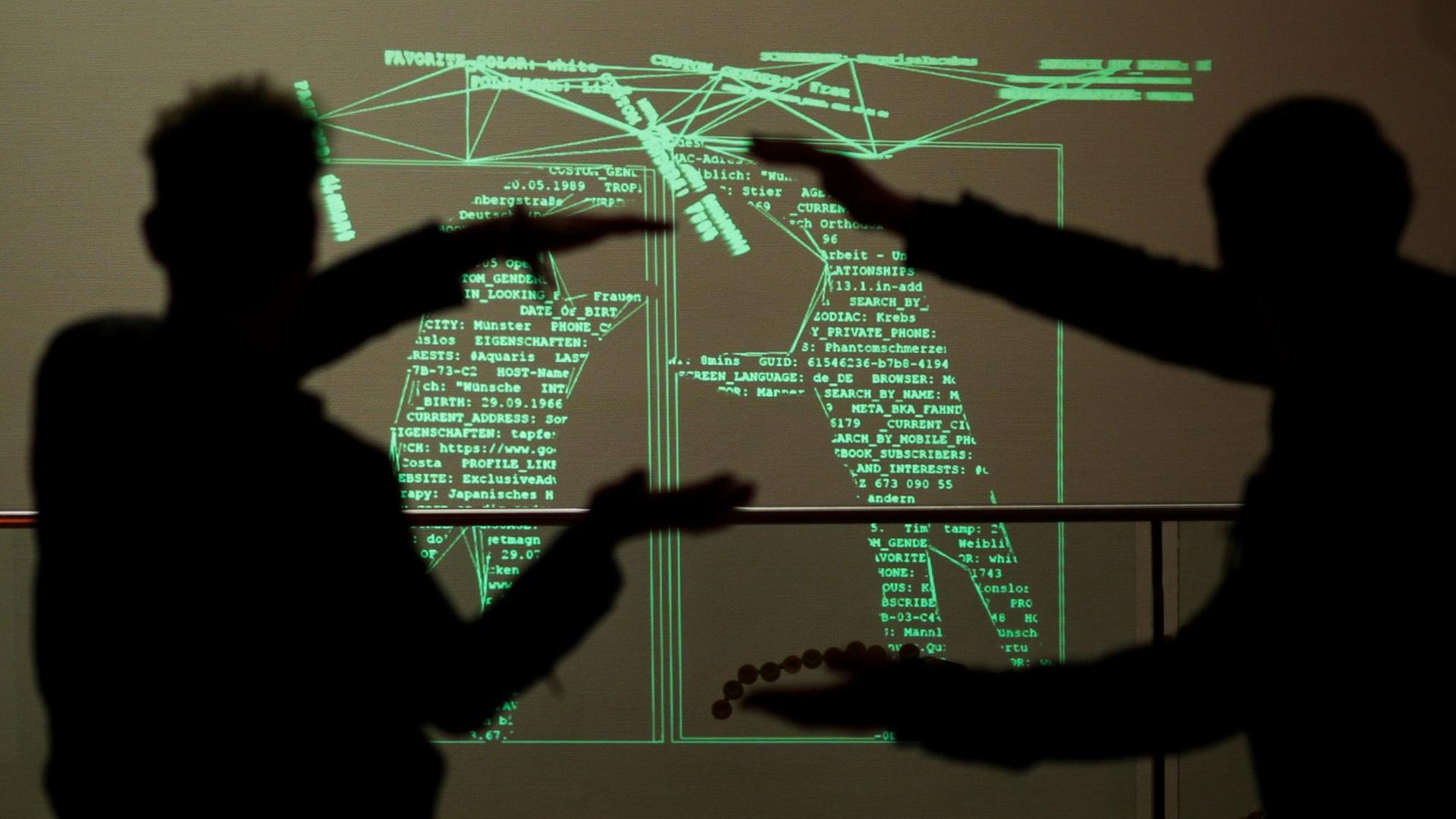

Masse von Informationen in den Sozialen Netzwerken

Allerdings landen nur die wenigsten rechtswidrigen Aussagen wirklich vor Gericht. Der weitaus größere Teil bleibt bei den Netzwerken veröffentlicht, da Facebook oder Twitter sich nicht in der Pflicht sehen, die Inhalte auf ihren Wahrheitsgehalt hin zu überprüfen. Und selbst wenn sie es wollten, ist unklar, wie eine Kontrolle ihrer Seiten in der Praxis ablaufen kann. Denn niemand könne die Masse an Informationen bewältigen, befürchtet Simon Hegelich von der Technischen Universität München:

"Das kann keiner lesen. Wir haben in Deutschland 30 Millionen Facebook-Nutzer. Wenn jeder von denen zwei Posts einstellt, habe ich 60 Millionen Posts am Tag. Wie viele Leute brauche ich, um 60 Millionen Posts zu lesen und zu bewerten?"

Facebook könne deshalb nur automatisiert über seinen Algorithmus steuern, was angezeigt werden darf und was nicht. Dieses Verfahren aber habe seine Grenzen.

"Es läuft sehr viel automatisch, es läuft über Algorithmen, die das identifizieren und diese Algorithmen machen auch systematische Fehler und sehen Sachen nicht und andere Sachen leichter. Es gibt immer das schöne Beispiel, warum kann Facebook nackte Brüste zensieren, aber keine Hate Speech. Es ist halt sehr leicht, einen Algorithmus zu entwickeln, der Nippel erkennt auf Fotos. Es ist aber sehr schwer, einen Algorithmus zu entwickeln, der Hate Speech von Ironie unterscheiden kann."

Ausgerechnet Fake News profitieren also vom aktuellen Facebook-Algorithmus. Denn dieser belohnt quasi Meldungen, die schnell und häufig geteilt werden - in der Timeline der Nutzer schiebt der Algorithmus diese Nachrichten weit nach vorne.

Facebook hat nun erste Maßnahmen angekündigt, um Fake News einzudämmen. Zum einen will das Unternehmen das Werbegeschäft mit Fake News erschweren. Zum anderen sollen User die Möglichkeit erhalten, mutmaßliche Falschnachrichten auf den Seiten zu melden. Ferner kündigte Facebook an, mit dem deutschen Rechercheverbund Correctiv zusammenarbeiten zu wollen. Eva-Maria Kirschsieper von Facebook Deutschland:

"Die werden sich die gehäuften Meldungen von Fake News vornehmen und überprüfen. Und dann mit einem Label versehen, wenn sie denken, dass dieser Inhalt nicht richtig ist, dann steht dort: Wird von Correctiv angezweifelt. Das heißt, die Menschen, die ab dem Moment die Inhalte sehen, die werden darauf aufmerksam gemacht, dass diese Inhalte nicht rechtes sind, beziehungsweise nicht korrekt sind."

Der Rechercheverbund Correctiv und Facebook

Correctiv gründete sich 2014 mit dem ambitionierten Ziel, in Zeiten sinkender Redaktions-Budgets aufwendige Geschichten eigenständig zu recherchieren, um sie anschließend Zeitungen, Hörfunk- oder Fernsehsendern anzubieten. Finanziert wird der Rechercheverbund von privaten Spendern. Auch Stiftungen und die Bundeszentrale für politische Bildung unterstützen die Arbeit.

Correctiv unterhält Journalisten-Büros in Berlin und Essen. Der Gründer David Schraven ist viel unterwegs. In einem Skype-Interview beschreibt er, wie die Arbeit für Facebook künftig aussehen könnte:

"User können bei Facebook Nachrichten melden, von denen sie glauben, die sind falsch, das sind Falschmeldungen. Wir gucken uns die Sachen an. Mit den Mitteln, die uns als Reporter zur Verfügung stehen. Und können dann halt nachher sagen: Okay., nach unserer Einschätzung ist das eine Falschmeldung, ist das eine Fake News, dann würden wir die markieren."

Facebook würde die überprüfte Meldung den Nutzern dann nochmals in die Timeline spielen – nun aber mit einem Warnhinweis der Faktenchecker:

"Da ist dann so eine Art gelber Knopf drauf und da steht dann: Unabhängige Faktenchecker halten diese Nachricht nicht für tauglich. Und wenn man da drauf klickt kommt man auf eine Erklärung, wo wir detailliert nachweisen, was wir an der Geschichte nicht richtig halten. Und warum und wie unsere Belege aussehen, so drum herum."

Auch in den USA arbeitet Facebook seit ein paar Wochen mit externen Fact-Checkern zusammen, etwa mit der Organisation Factcheck.org oder dem Fernsehsender ABC. Die Kooperationen seien ein erster Schritt, um Falschnachrichten in sozialen Netzwerken überhaupt kenntlich zu machen, meint Markus Beckedahl von Netzpolitik.org. Wirklich befriedigend sei die Zusammenarbeit aber nicht, denn:

"In einem Rechtsstaat, einer Demokratie sollten weiterhin Gerichte und Richter über Meinungsfreiheit entscheiden. Wir sollten das nicht im Rahmen einer Privatisierung der Rechtsdurchsetzung Unternehmen überlassen, die meinungsbildend, beinahe monopolistisch in unserer Gesellschaft wirken."

Hinzu kommt: Die Kriterien, nach denen Correctiv bei der Überprüfung der Meldungen vorgehen will, sind nach wie vor unklar. Offen ist etwa, wie die Mitarbeiter zwischen Meinungsäußerung und falscher Tatsachenbehauptung unterscheiden werden. Wie etwa wollen sie Sätze bewerten, die faktisch nicht nachprüfbar sind? Zum Beispiel Aussagen wie "Donald Trump gefährdet die Demokratie" oder "Wegen der Flüchtlinge wird das öffentliche Leben immer gefährlicher". David Schraven nennt ein Beispiel, das die Vorgehensweise der Correctiv-Leute verdeutlichen soll.

"Es gibt die die Meldung von Breitbart, dass in Dortmund zur Silvesternacht ein 1000-köpfiger muslimischer Mob die älteste Kirche Deutschlands angesteckt hat. Das war die Behauptung oder die Nachricht. Jetzt guckt man sich die an: 1000-köpfiger Mob, ja, da waren viele Leute, viele mit Migrationshintergrund, viele Muslime, viele Flüchtlinge. Ist das ein Mob, ist das kein Mob? Das weiß ich nicht, da würde ich sagen, das ist eine Meinungsäußerung."

Bald beginnt der Faktencheck in Deutschland

Correctiv werde diese Aussage "1000-köpfiger Mob" nicht beanstanden, erklärt Schraven, denn sie könne weder verifiziert noch falsifiziert werden. Anders sehe es bei den Fakten aus:

"Die älteste Kirche Deutschlands. Steht die in Dortmund? Nein, steht sie nicht, die steht in Trier. Der nächste Fakt ist: angesteckt oder nicht angesteckt? Also, da ist eine Kirche in Dortmund, wurde die angesteckt? Das kann man überprüfen, die Kirche kann man sich angucken und dann sieht man, nee, die steht noch und da ist auch nichts angesteckt. Und dann ist man halt dabei, dass man sagt, die Nachricht ist wohl eher Quatsch."

In gut zwei Wochen will das Recherchezentrum Correctiv mit dem Faktencheck in Deutschland beginnen. Bis dahin sollen weitere inhaltliche Fragen mit Facebook geklärt sein. Für das US-amerikanische Unternehmen wird Correctiv zunächst auf Probe und ohne Bezahlung arbeiten. Nur so könne seine Organisation ihre Unabhängigkeit wahren, sagt David Schraven.

Politikern in Berlin gehen die aktuellen, von Facebook angestoßenen Maßnahmen dennoch nicht weit genug. Sie haben in den vergangenen Wochen eine ganze Reihe von Forderungen an die sozialen Netzwerke formuliert. Die Grünen etwa verlangen, dass diese regelmäßig offenlegen, wie viele Beiträge sie gelöscht haben – ansonsten sollen Sanktionen finanzieller Art drohen. Die SPD will die Löschpraxis bei Facebook insgesamt verstärken. In einem Fernsehinterview sagte Fraktionschef Thomas Oppermann:

"Wir wollen, dass die Geschädigten sich zu Wehr setzen können, dass die einen Anspruch haben binnen 24 Stunden. Und wenn Facebook das nicht macht, dann drohen empfindliche Bußgelder, bis zu 500.000 Euro."

Auch die CDU/CSU-Fraktion im Bundestag verlangt in einem Aktionsplan, dass Facebook gemeldete Beschwerden innerhalb von 24 Stunden bearbeiten muss. Zudem soll der Anspruch auf Gegendarstellung nach dem Vorbild des Presserechts geprüft werden. Und wenn es nach den Vorschlägen des stellvertretenden Fraktionschefs Stephan Harbarth geht, sollen Geschädigte die Identität von Personen erfahren, von denen sie im Netz beleidigt wurden:

"Für uns ist wichtig, dass diejenigen, deren Persönlichkeitsrechte im Netz verletzt werden, dass sie Auskunftsansprüche haben. Sie müssen wissen können, wer sich hinter den Attacken verbirgt."

Und dennoch bleiben Lücken: So ist unklar, ob und wie der Gesetzgeber auch Nachrichtenübermittlungsdienste wie Messenger oder WhatsApp in die Pflicht nehmen kann. Denn immer mehr Fake News werden nicht nur über die Timeline von Facebook geteilt, sondern auch in einer geschlossenen WhatsApp-Gruppe weiterverbreitet – hier gilt es, Datenschutz-Fragen zu klären. Hinzu kommt die Frage, ob Facebook nur die wegen einer Falschaussage gemeldete Seite löschen muss. Oder grundsätzlich dafür sorgen muss, dass der verleumderischer Inhalt ganz aus dem Netz verschwindet. Mit dieser Frage werden sich die Würzburger Richter auch im Fall von Anas Modamanis Selfie mit der Kanzlerin beschäftigen.

*An dieser Stelle war zunächst von einem "Abwehrzentrum für Desinformation" die Rede - gemeint war natürlich "Abwehrzentrum gegen Desinformation."