Roland Meyer: "Gesichtserkennung. Vernetzte Bilder, körperlose Masken"

Verlag Klaus Wagenbach, Berlin 2021

80 Seiten, 10 Euro (Print) / 7,99 Euro (E-Book)

Wie man sich digital maskiert

Roland Meyer im Gespräch mit Max Oppel · 18.05.2021

Software zur Gesichtserkennung führt zum Ende der Anonymität im öffentlichen Raum, warnt der Bildwissenschaftler Roland Meyer. Er plädiert für politische Regulierung oder ein Verbot der Technologie und erklärt, mit welchen Tools man sich schützen kann.

Das Selfie gehört für viele Menschen zum Alltag: Mit dem Smartphone machen sie ein Foto von sich beim Joggen, vor dem Spiegel oder im Urlaub und posten dieses Bild in den sozialen Netzwerken. Doch diese Aufnahmen können zur Überwachung und Strafverfolgung genutzt werden. Im vergangenen Jahr wurde beispielsweise bekannt, dass das Unternehmen Clearview AI solche Bilder in Datenbanken zur Gesichtserkennung sammelt, die etwa Polizeibehörden nutzen sollen.

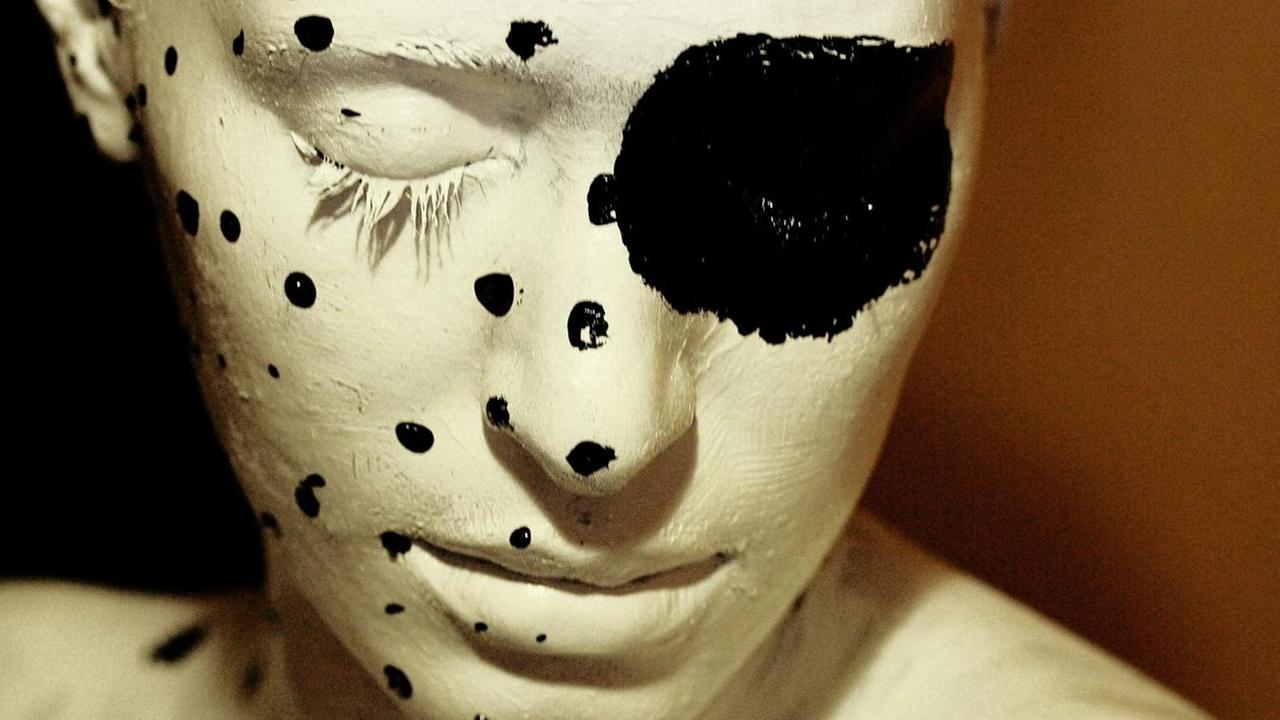

Eine Möglichkeit, um sich vor der Gesichtserkennung zu schützen, sind Filter, die man mit Tools wie Fawkes oder Lowkey über Fotos des eigenen Gesichts legt.

"Man kann damit ein Foto seines Gesichts quasi digital maskieren, sodass es von gängigen Algorithmen für ein anderes Gesicht gehalten wird", sagt Roland Meyer, Bildwissenschaftler an der Brandenburgischen Technischen Universität Cottbus-Senftenberg und Autor des Buches "Gesichtserkennung".

Die Tools veränderten das Bild auf Pixelebene und fügten minimale Störungen hinzu: Schatten, Flecken, Verzerrungen. Wenn ein so maskiertes Bild auf einer Plattform wie LinkedIn oder Facebook hochgeladen werde, lernten die Algorithmen, dem Profil ein falsches Gesichtsmuster zuzuordnen, erklärt der Bildwissenschaftler. Auf einem unmaskierten Bild, etwa von einer Überwachungskamera oder von Fremden auf der Straße aufgenommen, könnten die Algorithmen die entsprechende Person dann nicht identifizieren.

Wettlauf zwischen Täuschung und Training

Die perfekte Lösung für das Problem der Gesichtserkennung sieht Meyer in diesen Tools aber nicht. Erstens sei das jedes Mal ein gewisser Aufwand, wenn man ein Bild von sich hochlade. Und die maskierten Bilder seien zudem erkennbar nicht identisch mit den Ausgangsbildern: "Mein Gesicht erschien mir auf einmal fast unheimlich verfremdet", sagt Meyer. "Auf meine Uni-Webseite würde ich das Bild nicht stellen. Man wird nicht attraktiver davon."

Außerdem würden die Algorithmen zur Gesichtserkennung inzwischen auch auf diese Weise manipulierte Fotos trainiert: "Letzten Endes begibt man sich damit in eine Art Wettlauf zwischen Täuschung und Training."

Für manche Fälle, etwa Fotos von Demonstrationen, biete etwa die Messenger-App Signal mit einem Blurr-Filter eine Alternative zu Tools wie Fawkes an: Anstelle der Gesichter der Demonstrierenden sehe man damit nur noch einen unscharfen Fleck. Gesichtserkennung funktioniere so nicht mehr.

Das Ende der Anonymität

Im Falle von Clearview AI durften sich Investoren die Software zur Gesichtserkennung auf ihr Smartphone laden und konnten mit einem schnell geschossenen Foto von anderen deren Kontaktdaten und Social-Media-Profile finden, berichtet Meyer und warnt: "Das ist in der Konsequenz so etwas wie das Ende der Anonymität im öffentlichen Raum."

Der Bildwissenschaftler plädiert dafür, Gesichtserkennung politisch zu regulieren und sie mindestens vorläufig erst einmal nicht zu gestatten. In der Tech-Metropole San Francisco sei es der Polizei und anderen öffentlichen Behörden bereits verboten, Software zur Gesichtserkennung einzusetzen.

(jfr)