"FRA-5 – Die Schleuse einmal für vier Personen, bitte. Null Null Sieben."

"Vielen Dank."

Das Rechenzentrum im Osten Frankfurts ist ein Hochsicherheitsbereich. Kein Wunder, hier befindet sich der DE-CIX – der leistungsstärkte Internetnoten der Welt. Der Boden des langen Ganges glänzt. An der Wand hängt ein Spender mit Schaumstoffstöpseln:

Arnold Nipper: "Falls Sie Ohrstöpsel haben wollen."

Das ist der Gründer dieses Internetknotens, Arnold Nipper. Er hält seine Ausweiskarte vor das Lesegerät neben einer weißen Metalltür. Hinter der Tür kann man das Internet hören, sehen und spüren. Hier arbeitet ein Teil der Maschine, die ganze Industrien zerstört und neue aufgebaut hat, die Wissen verteilt, genauso wie Lügen, die jedem eine Stimme zu geben verspricht, uns produktiver macht, uns von der Arbeit ablenkt, Fremden vorstellt, durch Städte führt, die Einkäufe abnimmt. Vorhergesehen hat das niemand.

Die Macht, Dinge zu verändern, hat das Internet nicht durch Zufall. Sie steckt in den technologischen Prinzipien des globalen Netzwerks. Fast auf den Tag genau vor 50 Jahren übertrug der Vorgänger des weltweiten Netzwerks sein erstes Wort:

Leonard Kleinrock: "Der einzige Beleg für dieses Ereignis ist ein Eintrag in diesem Logbuch, das ich gerade vor mir liegen habe. Das Datum lautet: 29. Oktober 1969. 10:30 Uhr in der Nacht. Und da steht: Mit dem Stanford Research Institut Host zu Host gesprochen."

ARPANET – Der Vorgänger des modernen Webs

Wenn die erste Nachricht, die über das Internet geschickt wurde, so etwas wie die Mondlandung wäre – Leonard Kleinrock wäre Neil Armstrong. Der Mann war dabei. In den 1960ern arbeitete er als Wissenschaftler an der University of California. Es war eine Zeit, in der Computer teuer waren und das Format von Kleiderschränke hatten. Das amerikanische Verteidigungsministerium förderte ein Projekt, das die Rechner der Wissenschaftler vernetzen sollte – das ARPANET.

Kleinrock: "Wir wurden ausgewählt, der erste Knoten des ARPANETs zu sein. Als nächstes bekam das Stanford Research Institut in Nordkalifornien die nötige Hardware. Eine Datenverbindung zwischen den beiden Einrichtungen wurde gelegt. Sie hatte eine atemberaubende Geschwindigkeit von 50.000 Bit pro Sekunde – heute wäre das ein Witz."

Das ARPANET sollte die damals so kostbare Ressource Rechenleistung an verschiedene Forscher verteilen:

Kleinrock: "Damit das klappt, muss man sich von einem Rechner über das Netzwerk in einen anderen einloggen können. Das war auch der Zweck dieses Experiments. Wir mussten auf unserem Computer L-O-G eintippen und der Rechner am anderen Ende des Netzwerks würde das I-N selbst vervollständigen."

In dieser geschichtsträchtigen Nacht saßen Leonard Kleinrock und einer seiner Studenten vor ihrem Computer der University of California. Ein weiterer Programmierer bediente den Rechner im fernen Stanford:

Kleinrock: "Wir wussten nicht, was passieren würde, also hatten Charlie und Bill auch eine Telefonverbindung, um zu reden. Was für eine Ironie der Geschichte! Wir haben ein Telefon benutzt, während wir eine Technologie testeten, die die Telefonnetze irgendwann zerstören würde."

Es ging los:

Kleinrock: "Charlie tippet das L ein und frage über das Telefon: Hast Du das L bekommen? - Ja, hab das L. - Er tippte das O. Hast Du das O? - Japp, hab das O. - Tippte das G. Hast Du das G? - Crash!"

Der Rechner in Stanford war abgestürzt:

Kleinrock: "Die erste Nachricht, die je über das Internet übertragen wurde, war LO, wie in ‘Lo and behold‘"

Was auf englisch so viel heißt wie: ‚Siehe da!‘

Kleinrock: "Wir hatten uns keine kluge Nachricht überlegt. Wir wollten uns doch nur einloggen! Wir waren nicht so clever wie Neil Armstrong mit seinem ‚großen Sprung für die Menschheit‘."

Computernetze im Kindesalter

Woher sollten sie auch wissen, welch großer Sprung ihnen da geglückt war? Wobei, Leonard Kleinrock schien zumindest eine Vermutung zu haben. Monate vor der ersten Nachricht hatte seine Universität eine Pressemitteilung herausgegeben. Darin sagte Kleinrock: "Computernetze befinden sich noch im Kindesalter."

Kleinrock: "Computernetze befinden sich noch im Kindesalter. Aber wenn sie mal groß sind, werden wir Zeugen von so etwas wie computerbetriebenen Gebrauchsgegenständen, die uns wie das Telefon oder elektrische Geräte heutzutage überall im Haushalt und in den Büros dienen werden."

Das klingt tatsächlich nach den Laptops, Smartphones und vernetzten Fernsehern, die wir heute haben. Doch Kleinrock dachte noch viel weiter:

Kleinrock: "Was ich damals gemeint habe ist, dass dieses Netzwerk irgendwann unsichtbar werden würde. So wie Elektrizität auch unsichtbar ist. Das Internet ist aber noch nicht unsichtbar. Es ist mitunter kompliziert zu bedienen, man hat verschiedene Apps und Tastaturen und Sprachen. Das wird sich ändern. Das Internet entkommt der virtuellen Welt der Bildschirme und geht in die reale Welt über – das sehen wir beim Internet der Dinge. Wir fügen in unsere Wände, Autos und Körper immer mehr Sensoren, Mikrophone und Computersysteme ein. Das Internet verschmilzt mit unserer Umgebung. Wir werden mit ihm so interagieren, wie wir zwei jetzt miteinander sprechen. Meine Vorhersage ist also ein allgegenwärtiges globales Nervensystem namens Internet."

Die virtuellen Assistenten wie Siri oder Alexa – gebündelt mit dem Wissen von Datenbanken wie der Wikipedia – könnte man als Vorboten dieses globalen Nervensystems verstehen. Mit dieser Veränderung der Art, wie wir dem Internet begegnen, geht aber auch eine Veränderung der grundlegenden Struktur einher. Aber der Reihe nach.

Am Tag nach dem anfänglichen Crash klappte der Login zwischen der University of California und dem Stanford Research Institute. Das ARPANET begann zu wachsen. Es war aber noch nicht das Internet:

Kleinrock: "Im darauffolgenden Sommer hatten wir schon zehn Knoten. Das Netzwerk ging einmal quer durch die USA und wuchs weiter. Und weitere Netzwerke wurden angeschlossen. Zum Beispiel das Funk-basierte ALOHANET in Hawaii. Und wir hatten eine Satellitenverbindung nach England, an der Computer in Europa hingen. Die nannten wir SATNET."

Die Essenz des Internets

Diese einzelnen Netze funktionierten nach ihren eigenen Regeln. Sie hatten eigene Sprachen. Zwar konnten sie mit dem ARPANET sprechen, aber nicht unbedingt untereinander. Um das zu lösen, musste eine gemeinsame Sprache her – ein Protokoll, das alle Netze verstanden. 1974 entwickelten Vint Cerf und Bob Kahn genau das: Das TCP:

Kleinrock: "Das heißt Transmission Control Protocol. Damit konnten alle Netzwerke die gleiche Sprache sprechen. Es erlaubte das Netzwerken zwischen verschiedenen Netzen. "Inter-Networking" – wir begannen es, das Internet zu nennen."

Dieses Protokoll ist bis heute die Essenz des Internets – wenn auch in abgewandelter Form. Es basiert zum einen auf einer Technologie namens Packet-Switching: Lange Nachrichten oder große Dateien werden im Internet nicht am Stück verschickt:

Kleinrock: "Wir nehmen eine lange Nachricht und teilen sie in Pakete auf. Es ist als würde man einen Brief nehmen und den Inhalt auf Postkarten übertragen und sie einzeln verschicken und der Empfänger fügt sie dann wieder zusammen. Diese Pakete wandern durchs Netzwerk, nehmen den effizientesten Weg, werden am Zielcomputer gesammelt und zusammengesetzt."

Revolutionäres Ende-zu-Ende-Prinzip

Mit diesem Verfahren konnte man eine Datenleitung für mehrere Verbindungen gleichzeitig nutzen. Etwas, das etwa beim Telefonnetz damals nicht möglich war. Es ist eine sehr effiziente Art, die teuren Leitungen auszureizen. Die zweite wichtige Technologie – und die wirkliche Neuerung, die das TCP-Protokoll mit sich brachte – war das Ende-zu-Ende-Prinzip. Die Netzwerke kommunizierten im Grunde folgendermaßen miteinander:

Kleinrock: "Ich schicke etwas, wenn es Dich erreicht, sag mir, Du hast es. Wenn es Dich mit Fehlern erreichst, sag mir, es ist was falsch und ich schicke es nochmal. Das ist Ende-zu-Ende."

Dieses Ende-zu-Ende-Prinzip war die Revolution. Die Computer an den Endpunkten der Netze übernahmen damit die Steuerung des Netzwerks. Sie verschickten die Pakete und prüften, ob diese ankamen. Bis dahin waren die Netze noch komplexe Gebilde, an denen vergleichsweise simple Geräte hingen. So wie etwa das Telefonnetz. In diesen Fällen hatte der, der das Netz besaß, viel Macht. Das Internet war anders. Es funktionierte mit vergleichsweise simplen Netzen – wenn hier oder da mal ein Knoten ausfiel, konnten die Pakete schließlich über andere Knoten ausweichen. Die Macht lag an den Enden, bei den Computern und den Menschen, die sie bedienten. Das Internet ist eine Maschine, die ihnen die Macht gibt, sich zu vernetzen. Sie demokratisiert. Jeder hat eine Stimme, kann seine Ideen verbreiten und – wenn sie gut sind – verkaufen:

Geoff Huston: "Naja, sowas dachten wir zumindest bis vor etwa 15 Jahren. Und in den Anfangszeiten des Internets war es auch sicher so, dass es dem Nutzer diese Macht gegeben hat. Die Realität heute ist aber viel banaler. Es geht viel eher darum, Netflix-Filme zu streamen, als die Grenzen der menschlichen Entwicklung auszuloten."

Das sagt nicht irgendwer. Geoff Huston ist Chefwissenschaftler der asiatisch-pazifischen Verwaltung für Internet-Ressourcen. Sein ernüchterndes Urteil über das heutige Internet ist nichts, was er sich aus den Fingern saugt. Die Banalität ist wieder etwas, das man an der Technologie, an der Struktur des Internets ablesen kann. Die Struktur ist nämlich ein Spiegelbild der Wünsche und Bedürfnisse der Nutzer – und verändert sich nicht immer so , wie ihre Konstrukteure sich das wünschen. Das zeigt ein Beispiel aus den letzten Jahren.

Wandel der IP-Adressen

Das Internet basiert nicht nur auf TCP, sondern auf vielen anderen Protokollen. Ein entscheidendes ist das so genannte "Internetprotokoll" IP. Es sieht für jeden Computer im Internet eine IP-Adresse vor. Anhand dieser IP-Adressen wissen die Pakete, von wo sie kommen und wo sie hin müssen.

Huston: "Diese Adressen sind 32 bit lang. Damit kann man theoretisch 4,2 Milliarden Computer nummerieren. Und wir reden hier von den 1970ern und frühen 1980ern. Allein der Gedanke, dass es so viele Computer geben könnte, war ungeheuerlich."

Dann passierte etwas, ohne das es die ganze digitale Revolution – Internet hin oder her – nicht gegeben hätte: Halbleiter wurden günstiger, Computer kleiner, PCs kamen auf den Markt, dann Laptops, es wurden immer mehr, zudem entwickelte sich die Übertragungstechnik weiter. Hatte 1997 noch jeder fünfzigste Mensch auf der Welt Zugang zum Internet, war es zehn Jahre später schon jeder fünfte. Heute ist die halbe Weltbevölkerung online:

Huston: "So gegen, ach, ich weiß es nicht mehr genau. Es war um 1990 herum, da sagten einige Internet-Visionäre: Uns wird der Platz ausgehen! Diese vier Milliarden Adressen werden nicht genug sein!"

Also bereitete man sich vor. Die Internet Engineering Task Force, die Organisation, die die Standards im Netz bestimmt, begann Mitte der Neunziger, ein neues Protokoll zu entwerfen. Es hieß IP Version 6 und sollte Platz haben für 2128 Adressen. Eine unvorstellbare, 39-stellige Zahl. Doch die Umstellung auf dieses neue Protokoll geriet ins Stocken. Zum einen, weil sie für die Betreiber der Netzwerke, aus denen das Internet besteht, mit Kosten verbunden war. Zum anderen, weil in der Zwischenzeit etwas anderes passierte:

Huston: "Anfangs hatten tatsächlich noch alle Computer im Internet eine eigene Adresse. Jeder Computer konnte direkt mit jedem reden. Aber dann kamen die Privathaushalte. Und wenn die sich mit dem Modem ins Internet einwählten, bekam das Modem eine Adresse und selbst wenn es mehrere Computer im Haus gab, teilten die sich diese eine Adresse."

Über die Jahre haben die Internetanbieter diese Methode ausgeweitet, um mit ihren begrenzten IP-Adressen auszukommen. Heute hängen deutlich mehr Geräte am Internet als es IP-Adressen gibt. Damit ist das Ende-zu-Ende-Prinzip im Grunde gebrochen, denn die Computer kommunizieren nicht mehr direkt miteinander, sondern sozusagen über Mittelsmänner, die mit den Adressen jonglieren. Der einzelne Nutzer merkt davon im Alltag nichts, solange er das Internet nur konsumiert und keine eigenen Dienste anbietet. Das trifft eben auf die meisten zu. Das Internet ist heute ein kommerzielles Produkt. Die meisten Nutzer sind Verbraucher, Konsumenten. Aktuell verfügt nur etwa ein Viertel von ihnen über eine IP-Version 6-Adresse:

Huston: "Die Umstellung auf Version 6 ist nicht mehr so dringend. Wir haben es irgendwie als einfacher empfunden, die komplette Struktur des Internets zu verändert, als ein Protokoll auszutauschen. Das ist schon merkwürdig."

Die Richtung, in die sich das Internet heute verändert, hat viel mit dem wachsenden Hunger nach Videos und Unterhaltung zu tun.

Kommerzielle Internetknoten

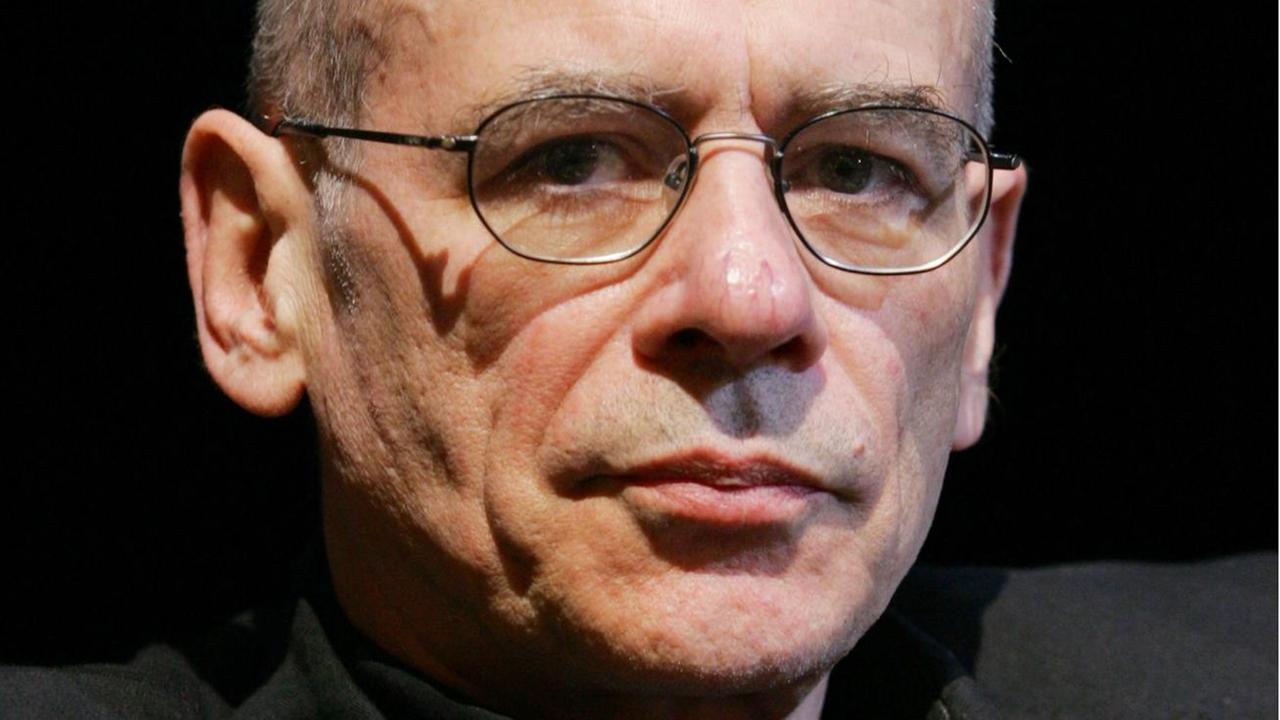

Im Frankfurter Büro vom De-Cix – dem kommerziellen Internetknoten – hat der Gründer Arnold Nipper in einem Besprechungsraum Platz genommen. Er ist 61, hat graues Haar und vor ihm steht ein Laptop, der mit Aufklebern übersäht ist. Bevor es in das Rechenzentrum geht, soll er hier ein Interview führen:

Carsten Titt: "Heute ist der große Tag in Anführungszeichen."

Sein Pressesprecher Carsten Titt sitzt auch in dem Raum.

Titt: "Heute Nacht war wirklich eine große Nacht wieder, nicht? Was war denn da los?"

Arnold Nipper: "Weiß ich nicht, ich weiß es nicht."

Titt: "Wir haben nämlich heute Nacht wieder einen Datenweltrekord gebrochen."

In dieser Oktobernacht hat der Knoten in der Spitze 7,4 Terabit pro Sekunde übertragen. Das entspricht 1,6 Millionen hochauflösenden Videos, die gleichzeitig durch das System wandern. Was diese Datenflut ausgelöst hat, ist nicht klar. Aber was macht ein kommerzieller Internetknoten überhaupt? Arnold Nipper erklärt es am Beispiel eines Internetnutzers:

Nipper: "Der Nutzer sitzt ja auf der anderen Seite. Auf der einen Seite sitzt Google oder Netflix und auf der anderen Seite sitzt der Anbieter, wo der Kunde angeschlossen ist."

Die Daten, die der Nutzer haben will, stecken also in Netzwerken von Google oder von Netflix. Damit er an sie rankommt, müssen sie in das Netzwerk seines Internetanbieters fließen. Um komplizierte Umwege zu vermeiden, sind die Netzwerke an kommerziellen Internetknoten direkt miteinander verbunden. Hier in Frankfurt treffen 900 verschiedene Netze zusammen und tauschen ihre Daten aus. Dieser Austausch passiert parallel in mehreren Rechenzentren. Sie sind quer über Frankfurt verteilt. Das Zentrum im Osten der Stadt, ist also nur ein Teil des Internetknotens. Was da so dröhnt, ist ein Switch. Dieses Gerät:

Nipper: "Es empfängt ein Datenpaktet, guckt auf die Adresse drauf, schaut in seine Tabelle rein und bestimmt einen anderen Port und schickt es gleich wieder raus."

Es ist eine Art Weiche, die den Datenfluss steuert. Das Gerät an sich besteht aus einem großen Metallschrank, an dem zig gelbe Glasfaserkabel angeschlossen sind:

Nipper: "Da kommen die Kunden rein. Da kommt sozusagen Ihr PC. Hängt hier dran und von hier aus geht es über diese Kabel da hin, falls nötig geht es an das andere Ende von Frankfurt und dann zu Google."

Wenn sich der Nutzer eben über seinen PC mit Google oder einen anderen Dienst im Internet verbindet. Diese physikalische Repräsentation des Konzepts Internet, hat mit ganz gewöhnlichen Problemen der echten Welt zu kämpfen – zum Beispiel mit Staub. Wenn der seinen Weg in die Glasfaser-Verbindungen finden, muss Annette Wilderotter ran:

Annette Wilderotter: "Putzen heißt konkret, dass wir vor dem Gerät eins von diesen gelben Kabeln rausziehen müssen, mit speziellen Baumwolltüchern in die Optik rein gehen und das putzen. Dann mit einem anderen Gerät den Stecker selber reinigen und wieder reinstecken."

Annette Wilderotter ist als Betriebsingenieurin nicht nur für so etwas zuständig. Sie kommt auch ins Rechenzentrum, wenn in dem großen Schrank, dem Switch, eine der Karten kaputt geht, die die Daten der Kunden aufnimmt. Die muss sie dann austauschen, wobei sie schnell sein muss. Schließlich können die Daten der betroffenen Netze dann nicht mehr über diesen Knoten fließen. So ist das dann auch eher mit einem Formel-1-Boxenstopp zu vergleichen als mit einer elektrotechnischen Bastelei:

Wilderotter: "Wenn man zu zweit rausfährt, dann kann man diese Unterbrechung auf eine Minute begrenzen, weil einer schon mit der Karte bereitsteht, das schon so weit vorbereitet hat, dass man wirklich nur noch raus und neu reinstecken muss."

Es ist alles auf Effizienz getrimmt. Auch der Abtransport der heißen Luft, die die Geräte hier produzieren. Es ist tatsächlich windig an diesem Teil des Internets. Die Luft kommt aus dem Boden:

Wilderotter: "Wir haben das hier offen, um kalte Luft zuzubringen. Weil wenn man die Hand vor den Lüfter hält, merkt man, da kommt sehr warme Luft raus. Dadurch kommt jetzt ein Wind von unten hoch und wir haben hier schräg über uns auch noch die Warmluftabsaugung."

Bei dem heißen Wind drängt sich die Frage auf. Wird nicht allein schon der Energieverbrauch das Internet an seine Grenzen bringen? Wie lange kann das noch so weiter gehen?

Nipper: "Wenn wir bei den Rechenzentren gucken, die werden immer energieeffizienter. Das heißt, die Abwärme, die sie produzieren, wandeln sie auch wieder um oder nutzen Sie auch mal weiter."

Energieverbrauch des Datentransports

Die Internationale Energieagentur hat berechnet, dass der weltweite Datentransport im Jahr 2015 etwa 185 Terawattstunden an Energie benötigt hat. Das war etwas mehr als ein Prozent des weltweiten Stromverbrauchs. Aber: Je mehr Daten fließen, umso effizienter scheint die Maschine zu werden. Google hat mit maschinellem Lernen erforscht, wie man bei der Kühlung 40 Prozent Energie sparen kann. Die Abwärme eines Datenzentrums in Zürich heizt ein Schwimmbad, in Paris gibt es ein ähnliches Projekt. Wenn die Effizienz sich so weiterentwickelt, wie es in den besten Datenzentren heute der Falls ist, dann könnte der Energiebedarf der weltweiten Datennetze in den nächsten drei Jahren sogar sinken - um etwa 15 Prozent. Und das obwohl immer mehr Daten übertragen werden. - Kann es da Grenzen geben? Kann das Internet an den Datenmengen verstopfen?

Nipper: "Da sehe ich nicht, dass es da an Grenzen stößt. Ich sehe das ja an unserer Infrastruktur. Unsere Infrastruktur ist ausgelegt, um siebenmal so viel Traffic durchpumpen zu können. Und wir bauen es laufend aus, dass wir da auch nie in einen Engpass kommen."

Mit dieser Meinung steht Arnold Nipper nicht alleine da:

Huston: "Wir sehen noch keine Grenzen. Es entstehen neue Architekturen. Und das, was wir irgendwann mal als Grenzen betrachtet haben, konnten wir bisher einfach wegschieben."

Huston: "Wir sehen noch keine Grenzen. Es entstehen neue Architekturen. Und das, was wir irgendwann mal als Grenzen betrachtet haben, konnten wir bisher einfach wegschieben."

Sagt auch Geoff Huston. Er fügt aber etwas hinzu:

Huston: "Ist das jetzt eine beängstigende Entwicklung oder eine angenehme? Ich tendiere dazu, es als beängstigend anzusehen."

Digitalfirmen bauen eigene Netze auf

Zu tun hat das mit dem Erfolg der großen Internetfirmen. Facebook, Google, Netflix, Twitter, Amazon sind so bliebt, dass ständig Millionen Nutzer gleichzeitig ihre Dienste und Inhalte nutzen:

Huston: "Wenn so eine Firma jetzt einen Server hätte und zehn Millionen Leute wollen auf einmal dessen Dienste abrufen, dann haben die nicht viel Spaß. Es ist einfach zu viel Datenverkehr."

Millionen Menschen greifen ständig auf das Netz zu. In einem globalen, allgegenwärtigen Nervensystem, wie Leonard Kleinrock es sich vorstellt, würde sich das nochmal verstärken. Vor allem Videos müssen schnell übertragen werden und machen schon heute 75 Prozent des gesamten Datenverkehrs aus. Um diesem Bedarf gerecht zu werden, bauen die großen Firmen eigene Netze zur Verteilung ihrer Inhalte auf. So genannte Content Delivery Networks. Sie kopieren ihre Inhalte und transportieren diese Kopien in Datenzentren, die auf der ganzen Welt verteilt sind. Die Nutzer, die etwa einen Netflix-Film abrufen wollen, beziehen ihn dann nicht mehr aus den USA. Die Daten wandern nicht über den Atlantik. Nein, die Nutzer verbinden sich mit einem Datenzentrum in ihrer Nähe:

Huston: "Es ist schneller – das bringt die Physik mit sich. Die Belastung der Server lässt sich damit besser verteilen und es schützt die Unternehmen vor Cyberangriffen – schließlich sind ihre Daten auf verschiedene Datenzentren verteilt."

Dieses Prinzip haben die großen Internetfirmen nicht erfunden. Aber sie setzen es massiv ein:

Huston: "Inzwischen kommt 90 Prozent des Verkehrs von Datenzentren, die recht nah am Nutzer dran sind."

Wandel vom globalen Internet zu regionalen Netzwerken

Das einst offene, globale Netzwerk, das Computer und Menschen auf der ganzen Welt verbinden sollte, zerfällt unter dem Druck immer größerer Datenmengen zu kleinen, regionalen Netzen. Diese regionalen Netze bestehen aus Spiegelbildern der immer gleichen Inhalte, mit denen die Nutzer dann gefüttert werden:

Huston: "Es ist eine komplette Umwälzung des Internets. Es ist ein neues Internet. Ist das ein Problem für das Internet? Wohl kaum. Ist das ein Problem für uns alle? Das ist schon eine schwierigere Frage."

Es ist nämlich so, dass die Unternehmen, die bisher die Inhalte geliefert haben, jetzt auch langsam die Infrastruktur des Internets übernehmen. Denn wenn das Internet sich immer mehr lokal abspielt, lohnt es sich für die traditionellen globalen Anbieter wie AT&T oder die Deutsche Telekom nicht mehr, die Infrastruktur für den globalen Datenverkehr zu unterhalten:

Huston: "Sie bauen kaum Unterseekabel mehr. Stattdessen werden die meisten aktuellen Unterseekabel-Projekte von den Internetfirmen finanziert, die bisher vor allem Inhalte geliefert haben."

Content-Anbieter streben direkte Verbindung zum Nutzer an

Die großen Inhalte-Anbieter wie Google, Microsoft und Facebook besitzen heute mehr als die Hälfte der Glasfaser-Bandbreite unter dem Meer. Es bricht eine Zeit an, in der eine Handvoll sehr erfolgreicher Internetfirmen nicht nur die Inhalte im Netz liefern, sondern immer mehr Teile der Infrastruktur des Internets kontrollieren. In ihren Netzen können sie eigene Regeln durchsetzen, Konkurrenten das Leben schwer machen, Inhalte filtern. Noch sind sie auf Dritte angewiesen. Zum Beispiel auf die Internetanbieter, die praktisch die letzte Meile übernehmen und die Inhalte von den Verteilstationen in die Häuser der Nutzer bringen:

Huston: "Es ist aber nicht klar, wie lange das noch so bleiben wird. Die Versuche mit neuen Glasfasernetzen, Funkverbindungen in der oberen Atmosphäre und Satelliteninternet lassen darauf schließen, dass Firmen wie Google eine direkte Verbindung zum Nutzer haben wollen."

Googles Mutterkonzern testet inzwischen Heliumballons, die Menschen in entlegenen Regionen mit Internet versorgen. In manchen Orten der USA bringt er mit dem Projekt Google Fibre Breitbandinternet zu den Häusern seiner Kunden. Facebook bietet mit dem Projekt Free-Basic kostenfreie mobile Internetzugänge an, vor allem in Schwellen- und Entwicklungsländern. Dabei wählt Facebook die Seiten aus, die über diesen Dienst erreichbar sind.

Man kann diese Entwicklung so oder so sehen. Eine Perspektive wäre, dass unser Nutzerverhalten, unser Hunger nach Videos und Gratisinhalten das Internet zum Schlechten gewandelt hat. Dass dadurch die Macht, die dieses Netz dereinst an seine Endpunkte verteilt hat, immer mehr in die Hände einiger weniger Monopolisten fällt. Man könnte es auch andersherum sehen, nämlich dass das Internet nach wie vor etwas Demokratisierendes ist. Schließlich sind es die Wünsche der Nutzer, die es mit seiner neuen Struktur erfüllt. ,Aber wie werden diese Wünsche in Zukunft aussehen? Leonard Kleinrock, der Mann der ersten Stunde:

Kleinrock: "In den letzten 50 Jahren waren wir grottenschlecht darin, die Anwendungen im Netz vorherzusagen. Niemand sah die Email kommen. Niemand sah Youtube kommen. Niemand sah Suchmaschinen kommen. Niemand sah Soziale Medien kommen. Niemand sah die verschiedenen Aspekte künstlicher Intelligenz kommen. Wir haben ein System erschaffen, das uns ständig überrascht und den kommenden Generationen neue Möglichkeiten eröffnet. Das ist vielleicht keine befriedigende Antwort, aber mehr kann ich gerade auch nicht sagen."