Manchmal muss man eben doch versuchen, das sprichwörtliche Rad neu zu erfinden - so ungefähr könnte das Motto der drei KI-Experten Joshua Tenenbaum, Brendan Lake und Ruslan Salakhudinov lauten. Denn sie beschäftigen sich mit einem Problem, das für Computer quasi schon gelöst ist – mit dem Erkennen von Handschriften. Warum das für einen Rechner prinzipiell schwer ist, ist klar: Kein Mensch schreibt wie der andere - und kein Mensch schreibt einen bestimmten Buchstaben immer exakt gleich.

Herkömmliche KI-Programme setzen daher auf die sogenannte "Pattern recognition", die Mustererkennung: sie suchen in einem neuen Bild nach charakteristischen Pixelstrukturen, die sie zuvor anhand einer großen Reihe von Testbildern gelernt haben. Menschen dagegen gehen anders vor

"Wenn Menschen lernen, unbekannte Schriftzeichen zu entziffern, dann sehen sie zum Beispiel in einem Buchstaben nicht einfach ein statisches Bild. Sie sehen stattdessen Strukturen, etwa wie das Zeichen in einer Abfolge von Federstrichen entstanden sein könnte oder einen Bewegungsablauf, mit dem sich der Buchstabe auf effiziente Weise abschreiben ließe. Wir haben versucht, einen Algorithmus mit den gleichen Fähigkeiten zu entwickeln - und dann zu schauen, wie er im Vergleich zu Menschen abschneidet."

Menschliche Blickweise übertragen

Die Grundstrategie des Algorithmus, so Brendan Lake von der New York University, ist der menschlichen Blickweise abgeschaut: Das Programm versucht einen Buchstaben zu erkennen, indem es verschiedene Wege ausprobiert, ihn mit einem virtuellen Stift möglichst effizient nachzuzeichnen.

Und was bei einer Handschrift effizient oder plausibel ist, lernt der Algorithmus am menschlichen Vorbild. Die Forscher ließen dazu Testpersonen die Buchstaben von 30 Alphabeten abschreiben – und zwar per Mausbewegung in ein Eingabefenster am Computerbildschirm. Anschließend wertete der Algorithmus die gesammelten digitalen Bewegungsdaten aus.

Dabei identifizierte das Programm charakteristische Einzelsegmente und deren dynamischen Verlauf - den senkrechten Strich von oben nach unten etwa oder den Halbkreis im Uhrzeigersinn. Vor allem aber ermittelte es, wie häufig denn solche Einzelsegmente und deren Kombinationen vorkamen - und zwar sowohl im zeitlichen Ablauf als auch in der räumlichen Anordnung. Mit dem Rüstzeug aus den Trainingsdaten kam der Algorithmus anschließend auch mit völlig neuen Buchstaben aus zuvor nicht trainierten Alphabeten zurecht:

"Wir haben das mit verschiedenen Aufgabenstellungen ausprobiert - zum Beispiel bekamen sowohl das Programm als auch Testpersonen einen Buchstaben aus dem ihnen unbekannten tibetischen Alphabet gezeigt und sollten den nachschreiben - oder sie bekamen ein paar solche Buchstaben zu sehen und sollten dann einen neuen schreiben, der zum tibetischen Alphabet gehören könnte."

Einzelsegmente und deren dynamischer Verlauf

Der Algorithmus schnitt bei beiden Aufgaben ebenso gut ab wie die menschliche Konkurrenz - und damit deutlich besser als bisherige Mustererkennungsverfahren.

Ein KI-Ansatz, der wie ein Mensch etwas Unbekanntes quasi auf den ersten Blick sinnvoll einordnet, der aus Bekanntem Neues sinnvoll ableiten kann - der schafft völlig neue Perspektiven, sagt Ruslan Salakhudinov von der Universität Toronto:

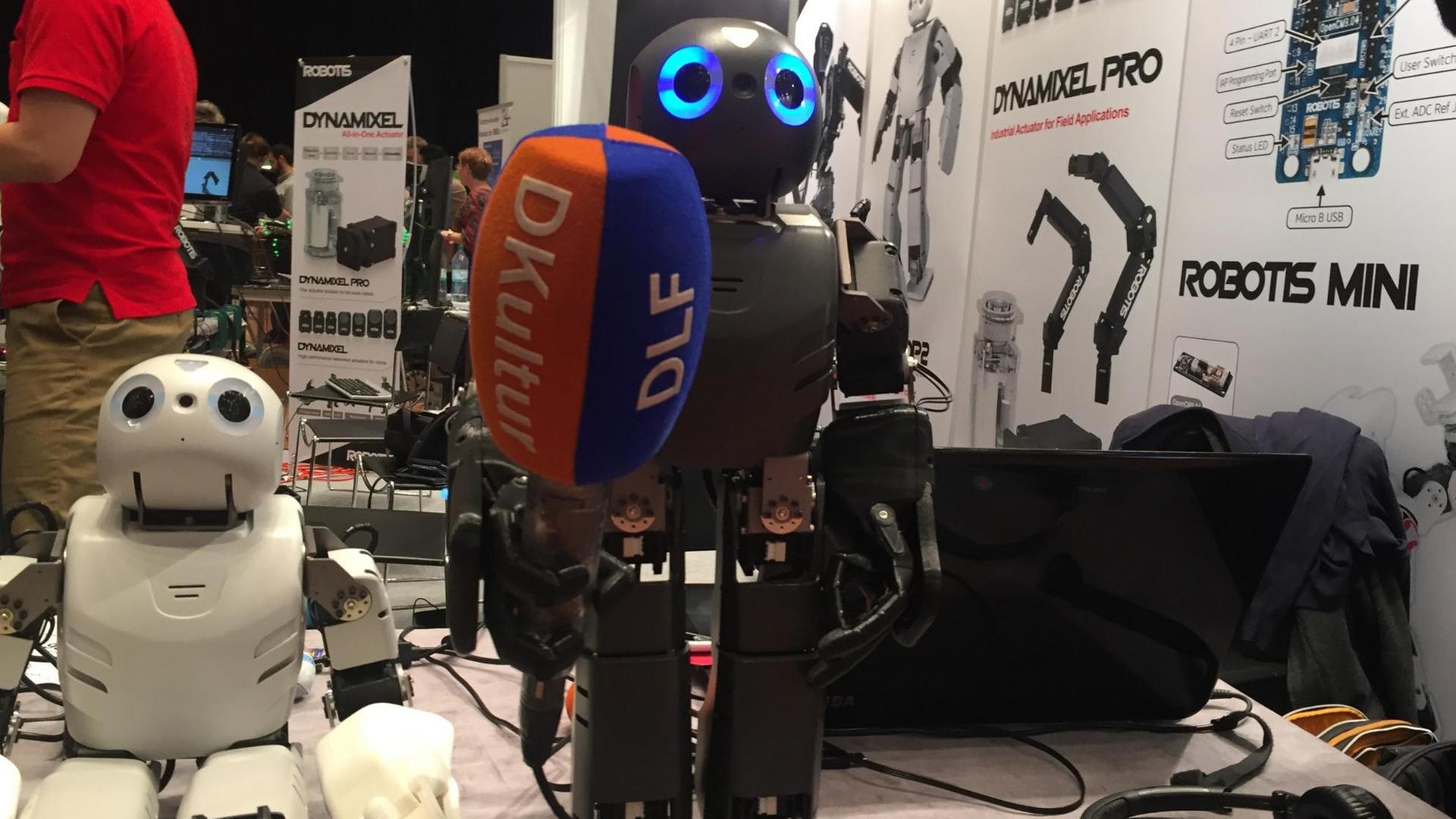

"Wenn wir zum Beispiel einen Roboter bauen wollen, der Dinge wie ein Mensch kategorisieren kann, dann muss er in der Lage sein, ständig neue visuelle Konzepte dazuzulernen, und zwar auf dem zuvor trainierten aufbauend. Wenn er das anhand von ein paar wenigen Beispielen könnte, um dann anschließend eine Szene korrekt zu analysieren, in der unbekannte Objekte vorkommen - das wäre von höchster Bedeutung."

Die Wissenschaftler sind zumindest auf lange Sicht sehr optimistisch, dass sich ihr Konzept auch auf andere Dinge als die Schrifterkennung übertragen lässt - und das sehen offenbar auch andere interessierte Kreise so; die Studie wurde von den Forschungsbüros der US-Army und der Marine finanziell unterstützt. Noch sind autonom handelnde Drohnen oder Droiden nicht in Sicht - aber bei der Science-Pressekonferenz stellte eine Reporterin eine sehr kluge Frage; Menschen würden ja auch zu Stereotypen und Vorurteilen neigen:

"Besteht nicht die Gefahr, dass Ihr Programm voreilige Schlüsse zieht, wenn es sich auf zu wenige Beispiele stützt?"

Und Joshua Tenenbaum vom MIT gab ihr grundsätzlich Recht:

"Diese Stereotypen oder Kurzschlüsse, die Sie ansprechen, das sind möglicherweise menschliche Schwächen als unausweichliche Konsequenzen unserer Stärken. Die spannende Frage ist also, wollen wir, dass Maschinen unsere Schwächen genauso erben wie unsere Stärken? Und ist es überhaupt möglich, dass sie die Stärken haben werden ohne die Schwächen?"