Katharina Zweig ist Professorin für Informatik an der TU Kaiserslautern und Sachverständige in der Enquete-Kommission des Bundestags für Künstliche Intelligenz. 2016, als KI noch nicht ganz so en vogue war, beschrieb sie hier in Forschung Aktuell einen von ihr für die Zellbiologie entwickelten Statistik-Algorithmus so:

"Mit sehr wenig Modifikation kann ich Ihnen auch sagen, welches das nächste Buch sein sollte, was Sie lesen werden. Oder ich kann damit herausfinden, welche zwei Nichtmitglieder einer sozialen Netzwerkplattform sich wahrscheinlich kennen."

"Mit sehr wenig Modifikation kann ich Ihnen auch sagen, welches das nächste Buch sein sollte, was Sie lesen werden. Oder ich kann damit herausfinden, welche zwei Nichtmitglieder einer sozialen Netzwerkplattform sich wahrscheinlich kennen."

Alle Problemfelder abgedeckt

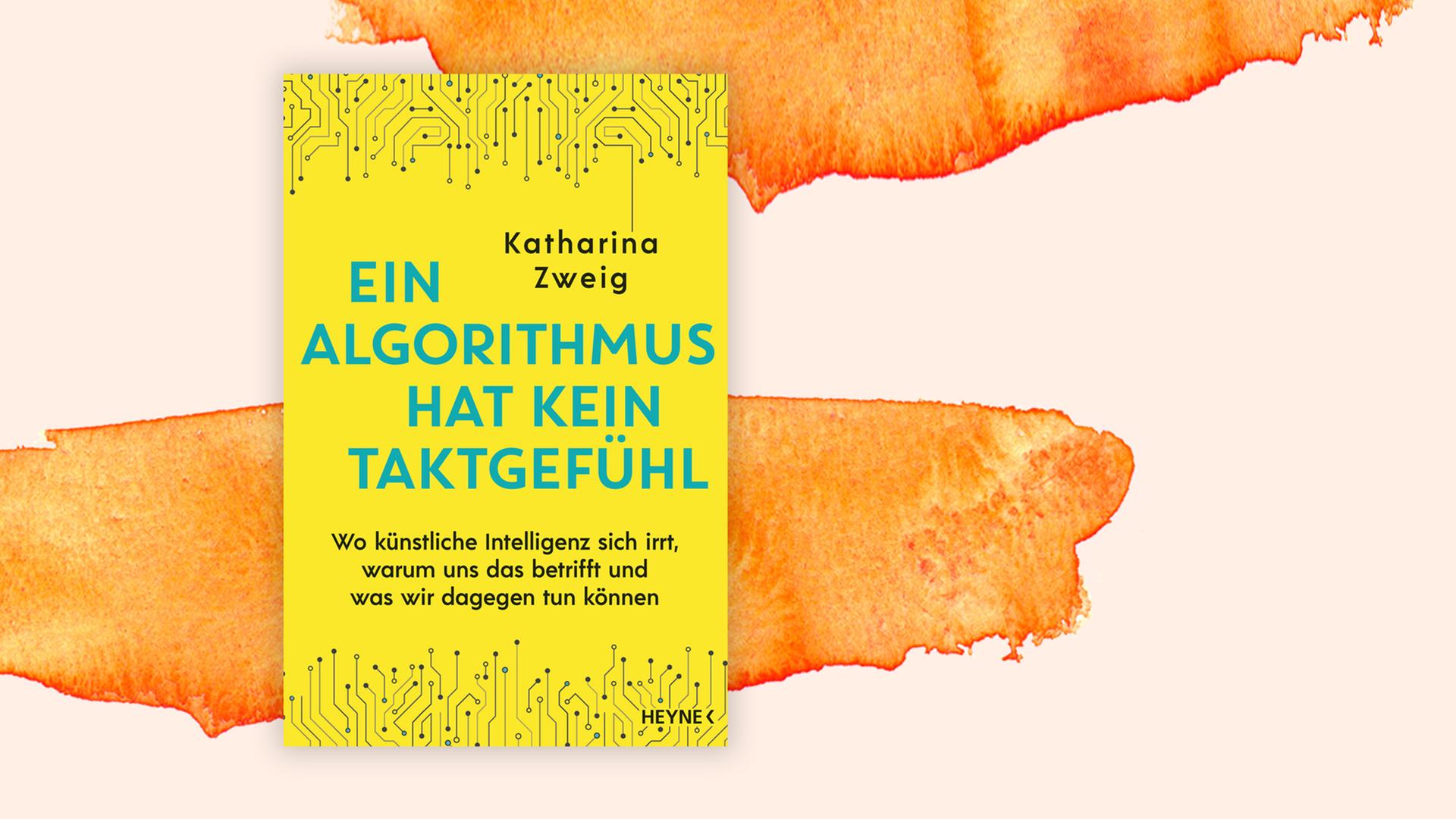

Jetzt hat Katharina Zweig ihr erstes populärwissenschaftliches Buch geschrieben. Sein Titel: "Ein Algorithmus hat kein Taktgefühl – Wo künstliche Intelligenz sich irrt, warum uns das betrifft und was wir dagegen tun können".

Das Buch hält, was der Titel verspricht, und deckt alle gängigen Problemfelder ab, die der Vormarsch lernfähiger Algorithmen mit sich bringt. Etwa die selbst für Netflix undurchsichtigen Empfehlungsalgorithmen für Netflix-Filme. Oder das Entscheidungsdilemma beim autonomen Auto, wo die Software über Leben und Tod entscheidet.

Das Buch hält, was der Titel verspricht, und deckt alle gängigen Problemfelder ab, die der Vormarsch lernfähiger Algorithmen mit sich bringt. Etwa die selbst für Netflix undurchsichtigen Empfehlungsalgorithmen für Netflix-Filme. Oder das Entscheidungsdilemma beim autonomen Auto, wo die Software über Leben und Tod entscheidet.

Software bringt Unschuldige ins Gefängnis

Das Leitmotiv, welches sich durch das ganze Buch zieht, ist die Kritik an COMPAS, der Rückfälligkeitsvorhersagesoftware für Straftäter, die im US-Justizsystem eingesetzt wird. Katharina Zweig hat in ihrem Team COMPAS untersucht und die diskriminierende Funktion dieses KI-Algorithmus statistisch exakt ermittelt. Sie zeigt zur Veranschaulichung in der Mitte des Buchs eine Zeichnung mit einem fiktiven Datenset von Kriminellen und Unschuldigen. Je nachdem, wie man in diesem Quadrat aus Datenpunkten eine Trennlinie zieht, kommen mehr oder weniger Unschuldige ins Gefängnis. Der ehemalige US-Vizepräsident Dick Cheney hielt es für deutlich wichtiger, "Kriminelle zu fassen, als Unschuldige zu schonen." Daher sieht auch seine Trennlinie anders aus: Er fasst alle Kriminellen, bringt aber acht Unschuldige ins Gefängnis.

Subtile Vorurteile und Fehleinschätzungen

An diesem Beispiel wird deutlich, dass die Kriterien, nach denen KI Entscheidungen fällt, von Menschen beeinflusst sind und auch moralische Abwägung enthalten können. Mit anderen Worten: Die Gewichtung eines gesellschaftlich wirksamen KI-Systems ist eine Frage der Ethik. Ein Programm kann zudem mehr oder weniger subtile Vorurteile und Fehleinschätzungen entwickeln, die ohne sorgfältiges Nachtrainieren immer größer werden – mit der Folge, dass beispielsweise für einen Job geeignete Bewerberinnen gar nicht erst zum Vorstellungsgespräch eingeladen werden.

"Wenn ein Lebenslauf angab, dass die Person Mitglied im Frauen-Schach-Club war, wurde das negativ bewertet. Ebenso wurden Zeugnisse von Colleges, die nur Frauen zulassen, negativer bewertet. Das kann passierten, wenn ein Algorithmus feststellt, dass diese Personen in der Vergangenheit weniger oft erfolgreich eingestellt wurden."

"Wenn ein Lebenslauf angab, dass die Person Mitglied im Frauen-Schach-Club war, wurde das negativ bewertet. Ebenso wurden Zeugnisse von Colleges, die nur Frauen zulassen, negativer bewertet. Das kann passierten, wenn ein Algorithmus feststellt, dass diese Personen in der Vergangenheit weniger oft erfolgreich eingestellt wurden."

Programmierer verantwortlich für die Konsequenzen?

Soweit ein inzwischen korrigiertes Verfahren von Amazon. Das Buch verspricht anfangs, dem Leser Werkzeuge an die Hand zu geben, selber am Algorithmus anzusetzen, also ihn zu verstehen und einzuschätzen. Dieses Versprechen wird nicht eingelöst. Man findet keine Zeile Code, man sieht keinen niedergeschriebenen KI-Algorithmus.

Dafür redet die Informatikerin ihren Kollegen deutlich ins Gewissen. Wenn klar ist, wozu eine Software dienen soll, schreibt sie, ist der Programmierer persönlich für die Konsequenzen ihres Einsatzes verantwortlich. Bei den mit klassischen Programmierverfahren erstellten Abgasmanipulationen deutscher Automobilhersteller trifft das eindeutig so zu. Bei KI-Programmen ist diese Unterscheidung schwieriger, weil die Software oft in völlig anderem Kontext eingesetzt wird, der Programmierer des Neuronalen Netzes also nicht weiß, wo sein Code irgendwann landet und was sein Algorithmus Böses lernt und anrichtet.

Dafür redet die Informatikerin ihren Kollegen deutlich ins Gewissen. Wenn klar ist, wozu eine Software dienen soll, schreibt sie, ist der Programmierer persönlich für die Konsequenzen ihres Einsatzes verantwortlich. Bei den mit klassischen Programmierverfahren erstellten Abgasmanipulationen deutscher Automobilhersteller trifft das eindeutig so zu. Bei KI-Programmen ist diese Unterscheidung schwieriger, weil die Software oft in völlig anderem Kontext eingesetzt wird, der Programmierer des Neuronalen Netzes also nicht weiß, wo sein Code irgendwann landet und was sein Algorithmus Böses lernt und anrichtet.

IT-Sachbuch als leichte Lektüre

Katharina Zweig hat ein sonniges Gemüt. Deswegen ist ihr Buch trotz der Generalkritik am hemmungslosen Einsatz von KI rundum positiv gestimmt und ihre Begeisterung ungebrochen:

"Wenn man mir eine Riesenfreude machen will, dann kippt man mir einfach einen schicken Datenhaufen vor die Tür."

Zielgruppe: Programmierer, die keine Ahnung von Ethik haben. Und: alle Nicht-Programmierer.

Erkenntnisgewinn: Künstliche Intelligenz muss kein Teufelszeug sein. Beim genauen Hingucken aber lassen sich Gefahren erkennen.

Spaßfaktor: Für ein IT-Sachbuch bemerkenswert leichte Lektüre.

"Wenn man mir eine Riesenfreude machen will, dann kippt man mir einfach einen schicken Datenhaufen vor die Tür."

Zielgruppe: Programmierer, die keine Ahnung von Ethik haben. Und: alle Nicht-Programmierer.

Erkenntnisgewinn: Künstliche Intelligenz muss kein Teufelszeug sein. Beim genauen Hingucken aber lassen sich Gefahren erkennen.

Spaßfaktor: Für ein IT-Sachbuch bemerkenswert leichte Lektüre.

Ein Algorithmus hat kein Taktgefühl. Wo künstliche Intelligenz sich irrt, warum uns das betrifft und was wir dagegen tun können

Sachbuch von Katharina Zweig

Heyne-Verlag 2019, 300 Seiten, 20 Euro

Sachbuch von Katharina Zweig

Heyne-Verlag 2019, 300 Seiten, 20 Euro