„Hab‘ ich es doch gewusst!“ Ein Gedanke, der vielen regelmäßig durch den Kopf schwirren dürfte. Ob beim Lesen der Nachrichten oder beim Scrollen in den Sozialen Medien: Menschen nehmen vor allem Informationen wahr, die ihre bestehenden Überzeugungen bestätigen – und übersehen, was nicht in ihr Weltbild passt.

Dazu kommt: Digitale Filterblasen machen es besonders leicht, im Netz nur auf das zu stoßen, was die eigene Annahme bekräftigt. Experten warnen vor den Folgen.

Der Confirmation Bias und wie er unseren Blick lenkt

Wir Menschen haben meist keinen objektiven Blick auf die Welt. Unsere Einstellungen und Überzeugungen verzerren (unbewusst) unsere Wahrnehmung. Die Psychologie spricht vom sogenannten Confirmation Bias, dem Bestätigungsfehler.

Aileen Oeberst, Professorin für Sozialpsychologie an der Universität Potsdam, erklärt das Phänomen so: Wer schon eine Vermutung oder Annahme über einen Sachverhalt hat, tut viel dafür, die eigene Sicht immer wieder zu bestätigen – statt sie zu hinterfragen.

Bemerkbar macht sich das schon bei der Informationssuche, weil beispielsweise politische Einstellungen die Recherche prägen. Auch bei der Frage, wie die gefundenen Informationen bewertet werden, mangelt es an Objektivität.

Als Beispiel nennt die Psychologin eine Studie aus den 1980er-Jahren zu einem TV-Duell im US-Wahlkampf, bei der Anhänger der Demokraten und Republikaner nach der Debatte jeweils ihren eigenen Kandidaten als klaren Gewinner einschätzten. Oeberst fasst das Ergebnis so zusammen: „Sie haben dieselbe Information unterschiedlich bewertet.“

Das heißt also: Wenn sich Menschen über ein Thema informieren, hat das, was sie im Vorfeld schon darüber denken, einen Einfluss darauf, wo sie nach Informationen suchen, welche ihnen besonders auffallen und wie sie diese am Ende bewerten. Oeberst führt solche Verzerrungen auf grundlegende Überzeugungen (Fundamental Beliefs) zurück und zählt dazu Annahmen wie: So wie ich die Welt sehe, ist es richtig.

Verzerrte Weltsichten und mediale Filterblasen

Weil wir Informationen oft verzerrt wahrnehmen, gibt es mitunter eine Diskrepanz zwischen dem, wie wir die Welt sehen und wie sie tatsächlich ist. Die Psychologin Oeberst sagt: „Alle haben ihre eigene Wahrheit.“

Noch deutlicher mache sich das Phänomen bemerkbar, wenn der Informationssuche eine Motivation zugrunde liege, wenn also ein bestimmtes Ergebnis erhofft wird.

Bestätigungsfehler sorgen also dafür, dass unser Blick auf die Welt nicht neutral ist. Dazu kommt, dass das Internet es besonders leicht macht, nur das zu sehen, was unser individuelles Weltbild bekräftigt, wie die Sozialwissenschaftlerin Maren Seehawer analysiert: „Der Algorithmus zeigt uns Suchergebnisse, die zu unserer individuellen medialen Filterblase passen.“

Seehawer warnt in dem Zusammenhang vor einer gesellschaftlichen Abwertung von Wissen und seriöser Information. Mit Verweis auf die schwedische Philosophin Åsa Wikforss spricht sie von „Wissensresistenz“: der Neigung zu glauben, was ins eigene Weltbild passt, anstatt zu glauben, wofür es gute Gründe gibt. Diesen Verlust einer gemeinsamen Faktenbasis hält sie für eine existenzielle Gefahr für die Demokratie.

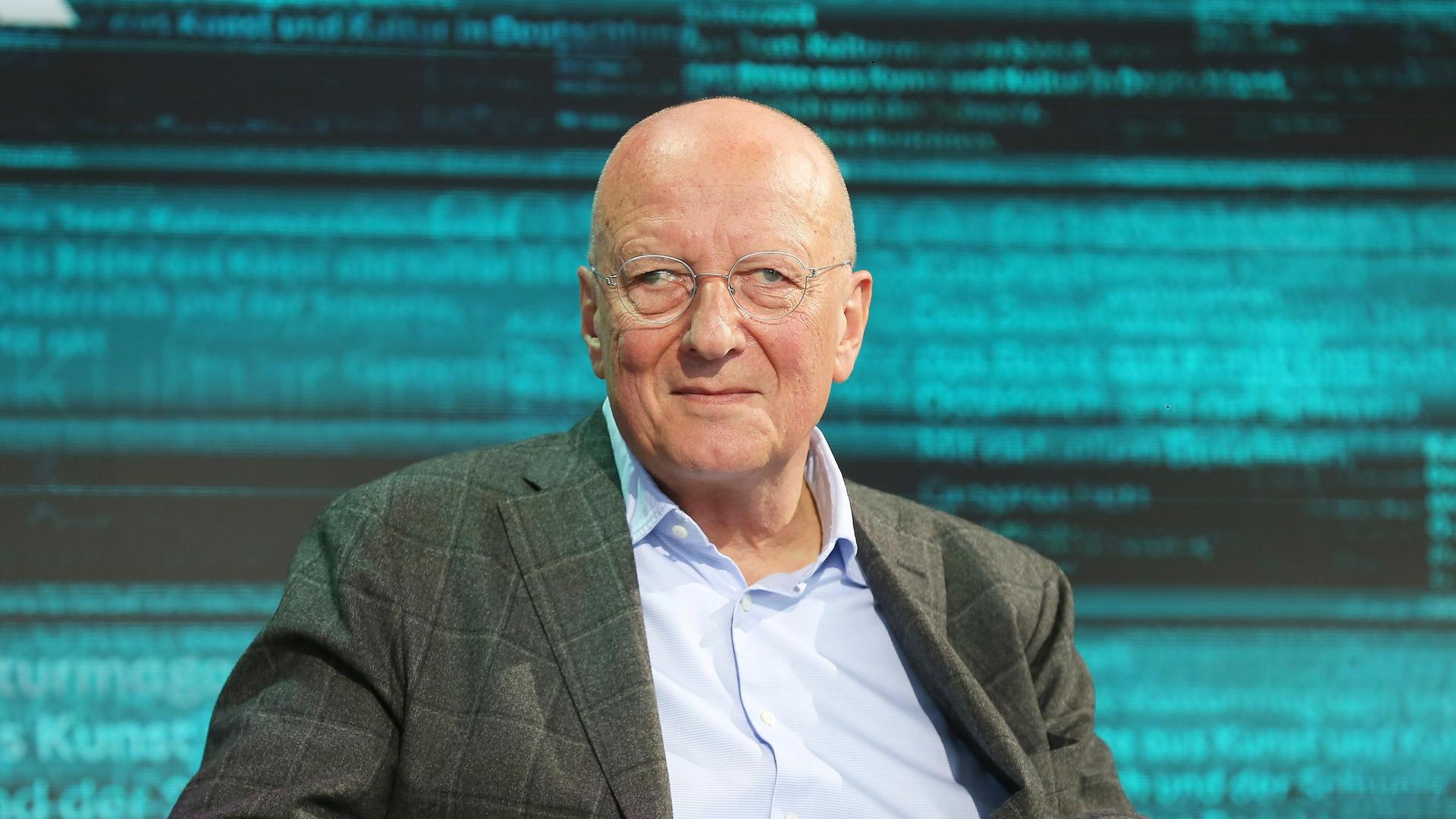

Auch der Rechtswissenschaftler und ehemalige Präsident des Bundesverfassungsgerichts Andreas Voßkuhle betont im Interview mit der Nationalen Akademie der Wissenschaft Leopoldina die gesellschaftliche Notwendigkeit „gemeinsamer Realitätsannahmen“. Wie Seehawer beobachtet er, dass die Trennlinie zwischen bloßer Meinungsäußerung und wissenschaftlicher Aussage für viele zunehmend verschwimme, etwa weil Zweifel an einer objektiven Wahrheit genährt und alternative Fakten und Verschwörungstheorien verbreitet würden.

Wie es um die Objektivität in der Wissenschaft steht

Doch auch Forschende sind nicht per se von Verzerrungen befreit. Welche Rolle spielen Werte und Einstellungen in der Wissenschaft? In der Forschung ist das Streben nach Objektivität ein hoher Wert – dazu gehört das Leitprinzip der Ergebnisoffenheit.

Der Soziologe Steffen Mau, Direktor am Max-Planck-Institut zur Erforschung multireligiöser und multiethnischer Gesellschaften in Göttingen, beschreibt es so: Wissenschaftliches Arbeiten setzt die Fähigkeit voraus, auch unerwartete Befunde zu akzeptieren, selbst wenn sie „einem vielleicht politisch nicht unbedingt in den Kram passen“.

Allerdings gehört zur Forschung auch, dass ein und dieselbe Fragestellung auf unterschiedliche Weise bearbeitet werden kann – was wiederum unterschiedliche Erkenntnisse hervorbringen kann. Das zeigt das Beispiel einer Studie in „Science Advances“ zu Auswirkungen von Migration.

Für das Experiment analysierten 71 Teams dieselbe Aufgabe mit denselben Daten – und kamen je nach Methode teils zu sehr unterschiedlichen Schlüssen. Laut der Studie gibt es eine Korrelation zwischen den Einstellungen der Forschenden und den Ergebnissen ihrer Arbeit. Gleichzeitig steht einer der Studienmacher selbst in der Kritik, weil er zwischenzeitlich US-Präsident Donald Trump beraten hat.

Der Soziologe Mau betont: Wissenschaftlicher Erkenntnisfortschritt basiere auf dem Prinzip „Versuch und Irrtum“. Aussagen seien oft vorläufig und würden mit neuer Evidenz korrigiert. Problematisch werde es hingegen, wenn „die Ergebnisse selber verzerrt sind oder einem so starken Bias unterliegen, dass sie eigentlich nicht falsifizierbar sind“.

Zwar könnten Werte und Einstellungen die Themenwahl bestimmen – nicht aber die Resultate. Weder die Haltung der Forschenden noch Politik dürfe über die Mittel entscheiden, die die Wissenschaft zum Erkenntnisgewinn heranziehe. Diese sollten allein auf wissenschaftlichen Regeln und Kriterien beruhen.

Strategien gegen kognitive Verzerrungen

Nach Einschätzung von Aileen Oeberst sind Bestätigungsfehler in der Gesellschaft weit verbreitet, werden aber nur selten reflektiert. Die Psychologin hält das für problematisch.

Sie wirbt dafür, die eigenen Annahmen immer wieder zu hinterfragen. Wer die eigene Brille absetzen und die Welt objektiver sehen wolle, müsse sich bewusst mit den Gegenargumenten auseinanderzusetzen.

Ähnliches fordert Mau, um die Forschung vor Verzerrungen zu schützen: „Man braucht einen Reflexionsprozess.“ Wissenschaftlerinnen und Wissenschaftler müssten eigene Werte und Erwartungen hinterfragen und auch unbequeme Resultate aushalten.

Darüber hinaus gibt es in der Forschung Wege, den Einfluss von Einstellungen und Werten zu reduzieren. Zum Beispiel mit sogenannten vorregistrierten Studiendesigns, sagt der Ökonom Michael Clemens von der George Mason University. Dabei lege man noch vor der Betrachtung der Daten fest, was mit diesen passieren werde, etwa welche Variablen in die statistische Analyse eingehen. „Dadurch sind einem in gewisser Weise danach die Hände gebunden.“

irs