"Ich würde das aber nach einer ersten Abschätzung auch für nicht vereinbar mit dem europäischen Datenschutzrecht halten. Da komme ich zu einem anderen Ergebnis als die eine oder andere Person, die sich dazu öffentlich geäußert hat."

Manfred Kloiber: So antwortete der Bundesbeauftragte für den Datenschutz Ulrich Kelber auf unsere Frage, ob wir künftig mit flächendeckender Videoüberwachung und Identifizierung der Menschen per Gesichtserkennungssoftware rechnen müssen. Anlass zu dieser Frage gab nicht nur uns der große Wirbel um die Foto-Datensammlung und die Gesichtserkennungs-App des New Yorker Unternehmens Clearview, der ja in dieser Woche aufpoppte. Was hat diesen Riesenwirbel um Clearview verursacht, Peter Welchering?

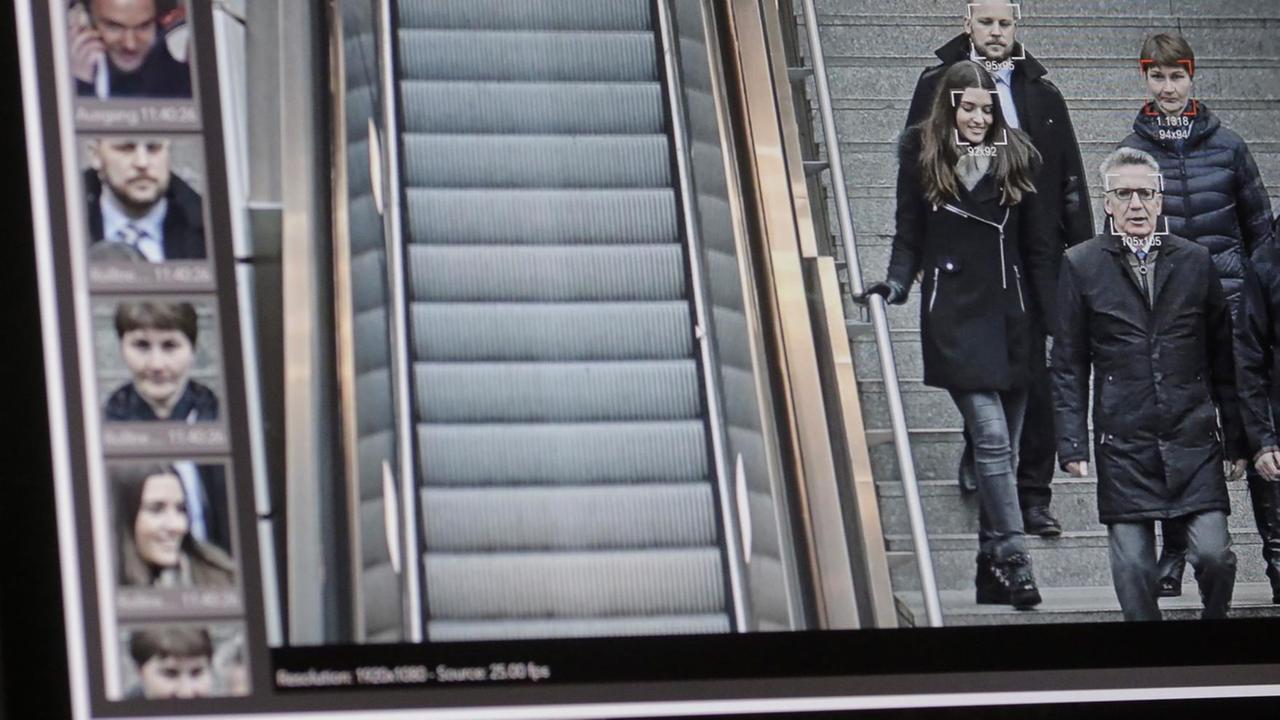

Peter Welchering: In erster Linie ist dafür die unglaubliche Unverfrorenheit verantwortlich, mit der Clearview Fotos aus dem Web abgegriffen hat. Laut Firmenangaben drei Milliarden. Und die stammen aus Twitter, Facebook, Instagram, die haben sich die Clearview-Verantwortlichen von Youtube und Unternehmens-Webseiten oder auch aus Blog-Beiträgen abgegriffen. Und diese riesige Fotosammlung ist die Basis der Dienstleistung, die über 600 Sicherheitsbehörden weltweit bei Clearview eingekauft haben, nämlich einen Abgleich von Videos aus Überwachungskameras mit diesen Personenfotos, um Menschen identifizieren zu können. Clearview hat sich zwar zu den von ihnen eingesetzten Algorithmen für die Gesichtserkennung und Identifizierung von Personen jetzt aktuell nicht äußern wollen. Aber da kann man aus früheren Äußerungen von Unternehmensvertretern und den Erfolgsberichten von Strafverfolgungsbehörden, die gerade rührende Geschichten über Personenidentifizierungen durch Clearview veröffentlicht haben, schon so einiges ableiten.

Clearview verwendet Standard-Algorithmen

Nach allen Informationen, die hier vorliegen, verwendet auch Clearview die klassischen Algorithmen für Gesichtserkennung Clearview selbst gibt eine Trefferquote von 75 Prozent an. Das entspricht dem Standard der heutigen Gesichtserkennungssysteme. Bei Tests von Megaface, die haben sich auf die Bewertung von Gesichtserkennungssystemen spezialisiert, erreicht Clearview über 90 Prozent Trefferquote. Diese beiden unterschiedlichen Zahlen zu den Trefferquoten widersprechen sich übrigens nicht, da die Treffergenauigkeit mit unterschiedlichen Methoden bewertet wird. Aber beide Zahlen zeigen an, dass Clearview mit den gängigen Algorithmen in diesem Bereich arbeitet.

Kloiber: Und das sind genau die Algorithmen, die auch Google bei seiner Gesichtserkennung einsetzt, die die Sicherheitsabteilung von Facebook verwendet. Es sind aber auch jene Algorithmen, die das Bundesinnenministerium sehr viel stärker auf Bahnhöfen, Flughäfen und an neuralgischen Punkten des öffentlichen Lebens einsetzen möchte. Das ist hochumstritten. Kritiker fordern sogar ein Verbot von Gesichtserkennungssoftware für die Analyse von Aufnahmen im öffentlichen Raum. Wir haben deshalb den Bundesbeauftragten für den Datenschutz und die Informationsfreiheit gefragt, wie der Einsatz von solcher Gesichtserkennungs- und Identifizierungssoftware zu bewerten ist. Ulrich Kelber:

"Die biometrische Gesichtserkennung kann ganz besondere Probleme auslösen, denn sie heißt ja eigentlich: Ich versuche erst einmal jeden zu identifizieren und zu vergleichen. Das heißt, ich werde auch als unbescholtener Bürgerinnen und Bürger erfasst, gespeichert, eventuell mit bestimmten Zusammenhängen, dann auch im polizeilichen Informationssystem geführt. Selbst wenn ich meine ganz normalen Grundrechte ausübe die Meinungsfreiheit oder Versammlungsfreiheit."

Deshalb tritt Ulrich Kelber für eine strikte Begrenzung von Gesichtserkennungssoftware ein. Für die Pläne aus dem Bundesinnenministerium, solche Identifizierungssysteme auf 135 Bahnhöfen und 14 Flughäfen in Deutschland einzuführen, kann sich der oberste Datenschützer überhaupt nicht erwärmen. Er sieht hier keinen Sicherheitsvorteil. Inzwischen hat Innenminister Seehofer diese Überwachungspläne am Freitag überraschend erst einmal auf Eis gelegt. Die intensive Diskussion über Gesichtserkennung, die die Foto-Datensammlung von Clearview ausgelöst hat, trug dazu bei. Denn sie hat den Blick auf die schon seit längerer Zeit geführte Debatte über Videoüberwachung geschärft. Ulrich Kelber:

"Ganz neu ist es nicht. Es wirft natürlich wieder Scheinwerferlicht auf verschiedene Debatten, die wir im Augenblick haben. Das fängt von biometrischer Erkennung an, das hinterliegt ja bei der ganzen Fragestellung. Also tatsächlich Fotos auszuwerten, zuzuordnen und darüber dann an vergleichbare Daten zu kommen, nicht einen einfachen Foto-Abgleich zu machen und über die Person zu führen. Die Tatsache, dass solche Datensammlungen angelegt werden, dass es erleichtert wird, aus Datenbeständen im Netz, die ja nun nicht für diesen Zweck gedacht waren, solche Daten abzugreifen, bis hin zur Frage auch, was private Unternehmen damit anstellen dürfen. Aber auch staatliche Sicherheitsbehörden. Es ist wie ein Beschleuniger für Debatten, die ohnehin stattfinden."

Wird parlamentarische Kontrolle umgangen?

Vor allen Dingen die Zusammenarbeit von privaten Überwachungsunternehmen mit ihren umfangreichen Bild-Datenbeständen sowie effizienten Algorithmen mit staatlichen Sicherheitsbehörden macht Bürgerrechtsaktivisten hier Angst. Besonders die kaum kontrollierten Nachrichtendienste könnten sich zum Risiko für den Rechtsstaat entwickeln. So fanden die Gesichtserkennungssysteme von Facenet großes Interesse im Bundesnachrichtendienst. Weil der aber nicht offiziell mit den Facenet-Machern zusammenarbeiten durfte, lief diese Kooperation eben über einen befreundeten Geheimdienst. Die Parlamentarier hatten und haben hier nach eigener Einschätzung kaum eine Chance, solche Aktivitäten zu unterbinden. Ulrich Kelber sieht hier dennoch einen Ansatz für bessere Kontrolle. Ulrich Kelber:

"Ich darf natürlich jetzt nicht aus meinen Aufsichtserkenntnissen beim Bundesnachrichtendienst sprechen, aber wer zum Beispiel die Verhandlungen in Karlsruhe in der letzten Woche verfolgt hat, wird gesehen haben, dass auch diese Fragestellung, was ist mit Erkenntnissen, die man in Deutschland sammelt, für ausländische Nachrichtendienste und deren Daten hier, wie werden die datenschutzrechtlich gefasst? Dass das eine wichtige Fragestellungen für die Zukunft sein wird. Ich glaube, es gibt natürlich auch für Daten, die im Ausland gewonnen werden, keinen Blankobrief beim Einsatz deutscher Nachrichtendienste."

Behörden drängen massiv auf Videoüberwachung

Kloiber: Was Ulrich Kelber da sagt, hört sich ja so an, als würde die Debatte über den Einsatz von Gesichtserkennungssoftware in Deutschland noch an Intensität und Schärfe zunehmen. Welchen Stellenwert hat denn der Einsatz von Gesichtserkennungssoftware für die Sicherheitsbehörden hierzulande, Peter?

Welchering: Die Strafverfolgungsbehörden drängen massiv auf den Ausbau von Videoüberwachung, vor allen Dingen an Bahnhöfen und Flughäfen. Dabei ist die Gesichtserkennung noch wichtiger als die Verhaltensprognose. Bei der Verhaltensprognose geht es ja um die Auswertung von Gesten, Bewegungen, Gehrouten mitsamt Geschwindigkeit, und sogenannte Gefährder zu erkennen. Also da trägt jemand einen Rucksack, schaut sich auf dem Bahnsteig mehrfach um, stellt den Rucksack und entfernt sich sehr rasch vom Bahnsteig, dann schlägt solch ein verhaltensbasiertes Überwachungssystem Alarm. Das sind Programme, die seit dem europäischen Indect-Projekt ziemlich rasant entwickelt wurden. Daneben hat die Gesichtserkennung erst während der vergangenen zwei Jahre so richtig Fortschritte gemacht. Bis dahin gab es immer Probleme mit stark abgeschatteten Gesichtern, mit teils verdeckten Gesichtern oder mit perspektiv verzerrten Gesichtern, die dadurch entstehen, dass die Überwachungskameras ja meist an Säulen oder unter der Decke hängen, die Menschen also von oben herab filmen. Gegenüber den Personenfotos, mit denen die Videoaufnahmen aus den Überwachungskameras dann abgeglichen werden entsteht dann eine perspektivische Verzerrung, weil diese Personenfotos ja auf gleicher Augenhöhe aufgenommen worden sind. Diese Probleme sind inzwischen wesentlich besser gelöst.

Neue Algorithmen können fehlende Bildteile ergänzen

Kloiber: Wie funktionieren diese Lösungen denn in technischer Hinsicht?

Welchering: Indem die klassischen Biometrie-Programme um ein generatives Netzwerk ergänzt wurden. Das Gesichtserkennungssystem vermisst sozusagen die Biometrie, also Augenabstand, Nasen-Nund-Abstand, Lippenform usw. Das sind bis zu 512 Messpunkte im Gesicht. Und damit kann ein Gesicht so individuell zugeordnet werden wie ein Fingerabdruck. Der zweite Algorithmus stammt aus der Klassischen Bilderkennung und wird zusätzlich zum Biometriealgorithmus eingesetzt. Dieser Algorithmus errechnet für die vier bis sieben Millionen Pixel eines Bildes eine Art Identifizierungswert. Jeder Bildpixel kann bis zu 256 Farbwerte haben. Die Kombination aus diesen Farbwerten, also 256 hoch 7 Millionen, würde einen Wahrscheinlichkeitswert ergeben, was auf diesem gesamten Bild zu sehen ist. Das ist ein irre hoher Rechenaufwand. Deshalb wird dieser Algorithmus häufig eingesetzt, um fehlende Bildmerkmale zu rekonstruieren. Also ein Mund, der durch einen Schal verdeckt ist, eine abgeschattete Gesichtshälfte, wodurch die Nase nicht so richtig zu erkennen ist. Auch eine perspektivische Rekonstruktion ist so möglich.

Kloiber: Aber diese Rekonstruktion hat ja ein neuronales Netz berechnet. Was macht da das generative Netzwerk bei der Gesichtserkennung?

Welchering: Beim generativen Netzwerk berechnet das erste Netzwerk mittels Wahrscheinlichkeitsberechnung, wie das rekonstruierte Gesichtsfeld aussieht. Das zweite Netzwerk muss überprüfen, ob dieses Gesichtsbild zutreffend ist oder nicht. Das macht es auch durch Wahrscheinlichkeitsrechnung auf der Grundlage der Farbwerte der Pixel. Wichtig ist dabei die Lernrate. So kann etwa das zweite Netzwerk die berechneten Bilder mit Bildern des Trainingsdatensatzes vergleichen und kann damit dann die konkrete Wahrscheinlichkeitsberechnung korrigieren.

Kloiber: Wie hoch ist dabei die Rate der Fehlidentifizierungen?

Welchering: Die falsch-positiven Zuordnungen, also dass eine Identität einem Überwachten fälschlicherweise zugeordnet wird, liegt so zwischen 20 und 25 Prozent im Mittelwert.

Kloiber: Über die aktuellen Diskussionen um den Einsatz von Gesichtserkennungssystemen berichtete Peter Welchering, vielen Dank!