In Bahnhöfen, auf Demos, in sozialen Netzwerken: In Deutschland setzen Sicherheitsbehörden schon lange biometrische Gesichtserkennungssysteme ein, um unbekannte Personen zu identifizieren. Befürworter von Gesichtserkennung sehen die Befugnisse von Polizei und Zoll zu stark eingeschränkt und wollen das ändern. Was plant die Politik? Und was kritisieren Bürgerrechtler und Datenschützer?

Wie funktionieren Gesichtserkennungssysteme?

Gesichtserkennungssysteme analysieren biometrische Merkmale wie Augenabstand, Kieferform oder Nasenlinien und gleichen diese mit Referenzdatenbanken ab. Zum Einsatz kommen dabei zwei grundsätzlich verschiedene Methoden:

- nachträglich, anhand bereits gespeicherter Bilder, und

- in Echtzeit, dabei werden Videobilder laufend analysiert und abgeglichen.

Aktuelle Systeme nutzen in beiden Fällen künstliche Intelligenz (KI).

Bisher wird Gesichtserkennung in Deutschland meist nachträglich eingesetzt. So zum Beispiel vom Bundeskriminalamt (BKA), der Bundespolizei, dem Zoll oder auch Landespolizeibehörden. Die am häufigsten eingesetzte Software wird vom BKA verwaltet und betrieben. Einige Landespolizeibehörden wie das LKA Sachsen haben eigene Systeme.

Die Behörden können damit Fotos mit Bildern aus Referenzdatenbanken abgleichen, die vor allem aus Ermittlungen stammen. In diesen Datenbanken befinden sich verurteilte Straftäter, Tatverdächtige, Asylsuchende und zum Teil Menschen mit Asyl. Der automatisierte Abgleich mit Bildern außerhalb der internen Datenbanken ist derzeit nicht zulässig – auch nicht mit Fotos aus sozialen Netzwerken oder öffentlich zugänglichen Webseiten.

Gesichtserkennung in Echtzeit darf nach der KI-Verordnung der EU nur zum Opferschutz und zur Terrorabwehr eingesetzt werden. Diese Ausnahmen nutzt ein Pilotprojekt in Frankfurt am Main. Kriminalhauptkommissar Sebastian Schäfer vom hessischen Polizeipräsidium für Technik ist dafür mitverantwortlich. Alle Passanten im Bahnhofsviertel würden gescannt und ihre Daten dann mit einer Referenzdatenbank abgeglichen, sagt Schäfer.

In dieser Datenbank sind Personen, die von der Polizei gesucht werden – im Fall des Pilotprojektes Opfer oder Gefährder. Für die Aufnahme in die Datenbank braucht es einen richterlichen Beschluss. Es sei denn, Polizeibeamte sehen eine akute Gefährdung. In diesem Fall müsse die Polizei die richterliche Entscheidung über die Aufnahme in die Datenbank innerhalb von 72 Stunden nachträglich einholen, so Sebastian Schäfer.

Wenn es beim Abgleich keinen Treffer gibt, würden die Daten wieder gelöscht, sagt Schäfer: „Alles das, was quasi mathematisch mit meinen Gesichtsmerkmalen berechnet wird, wird verworfen und mein Gesicht ist auch verworfen. Das kann nicht wiedererlangt werden.“

Weitere Pilotprojekte zur Echtzeiterkennung gab es in Mainz 2006 bis 2007 durch das BKA und in Berlin am Bahnhof Südkreuz 2017 bis 2018 durch die Bundespolizei. Seit 2019 arbeitet außerdem die sächsische Polizei mit einem Gesichtserkennungssystem, das – jeweils mit richterlicher Genehmigung – Echtzeiterkennung einsetzen kann. Sachsen verleiht die Technologie an Polizeibehörden in anderen Bundesländern.

Welchen Nutzen hat die Gesichtserkennung?

Befürworter von Gesichtserkennung argumentieren, dass die Aufklärung von Straftaten und die Ermittlung von Straftätern mit der KI-gestützten Technologie deutlich erleichtert werde. Ob aber Gesichtserkennung Straftaten verhindert, ist unklar. Einige Studien deuten zum Beispiel auf eine Reduzierung schwerer Gewaltkriminalität hin, während andere keine überzeugenden Beweise für eine Reduzierung der Kriminalitätsraten finden.

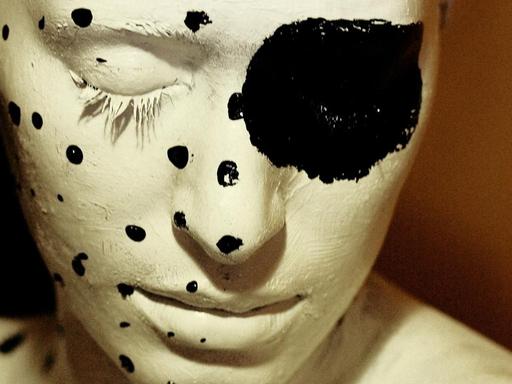

Hinzukommt, dass bei der Gesichtserkennung Fehler passieren. Es kommt vor, dass die Software Unbeteiligte für eine gesuchte Person hält („false positive“) oder eine gesuchte Person nicht erkennt („false negative“). Studien zeigen: Weiße Männer werden von gängiger Software am zuverlässigsten identifiziert. Frauen, ältere Menschen und Personen mit dunkler Hautfarbe werden häufiger falsch erkannt oder übersehen.

Bei dem Pilotprojekt der Bundespolizei am Bahnhof Berlin-Südkreuz lag die Erkennungsquote von freiwilligen Testpersonen bei rund 80 Prozent. Das bedeutet: Jede fünfte Zielperson wurde verfehlt. Auch Fehlalarme gab es: Sie lagen zwar nur bei unter 0,1 Prozent der mit Kameras überwachten Menschen. Übertragen auf den Frankfurter Hauptbahnhof mit täglich etwa 450.000 Besuchern wären das aber theoretisch bis zu 450 Falschmeldungen pro Tag. Möglicherweise ist die Fehlerquote inzwischen jedoch niedriger. Neuere Systeme gelten als präziser.

Was plant die Politik?

Das CSU-geführte Bundesinnenministerium will die Möglichkeiten der Gesichtserkennung für die Bundespolizeien ausbauen. BKA und Bundespolizei sollen Aufnahmen nachträglich auch mit Bildern aus dem Internet vergleichen dürfen, nicht mehr nur mit Fotos aus eigenen, datenschutzrechtlich kontrollierten Datenbanken. Die Grundlage dafür sollen zwei neue Gesetze sein. Die Entwürfe befinden sich derzeit in der Abstimmung zwischen den Ministerien.

Christoph de Vries, Parlamentarischer Staatssekretär im Innenministerium: „Wir können mit den Mitteln des 20. Jahrhunderts nicht die Kriminalität und die terroristischen Gefahren des 21. Jahrhunderts bekämpfen. Und deswegen geht es am Ende darum, die innere Sicherheit zu stärken und dafür unseren Polizeibehörden die notwendigen Instrumente an die Hand zu geben.“

De Vries kritisiert, dass Polizisten weniger Möglichkeiten haben als Bürgerinnen und Bürger. So suchten Journalisten Ende 2023 mit der Internetfotodatenbank „PimEyes“ nach der mutmaßlichen RAF-Terroristin Daniela Klette – und fanden ein „Match“ mit dem Bild einer Frau aus einem Verein in Kreuzberg. „PimEyes“ verstößt gegen EU-Datenschutzbestimmungen. Klette war damit aber identifiziert und wurde wenig später in Berlin verhaftet.„Das zeigt, glaube ich, die ganze Absurdität“, sagt Christoph de Vries. „Das, was Journalisten mit privaten Produkten machen dürfen, das muss unseren Sicherheitsbehörden möglich sein, wenn sie dem Schutzauftrag des Staates nachkommen können sollen.“

Was sagen die Kritiker?

Die Entwürfe des Innenministeriums stoßen auf Kritik bei Datenschützern, Bürgerrechtlern und der Opposition im Bundestag. „Wenn man sich die Gesetzentwürfe anschaut, dann nehmen die überhaupt keine Rücksicht auf die Fragen von Datenschutz, auf die Fragen von Privatsphäre“, sagt Marcel Emmerich, innenpolitischer Sprecher der Grünen.

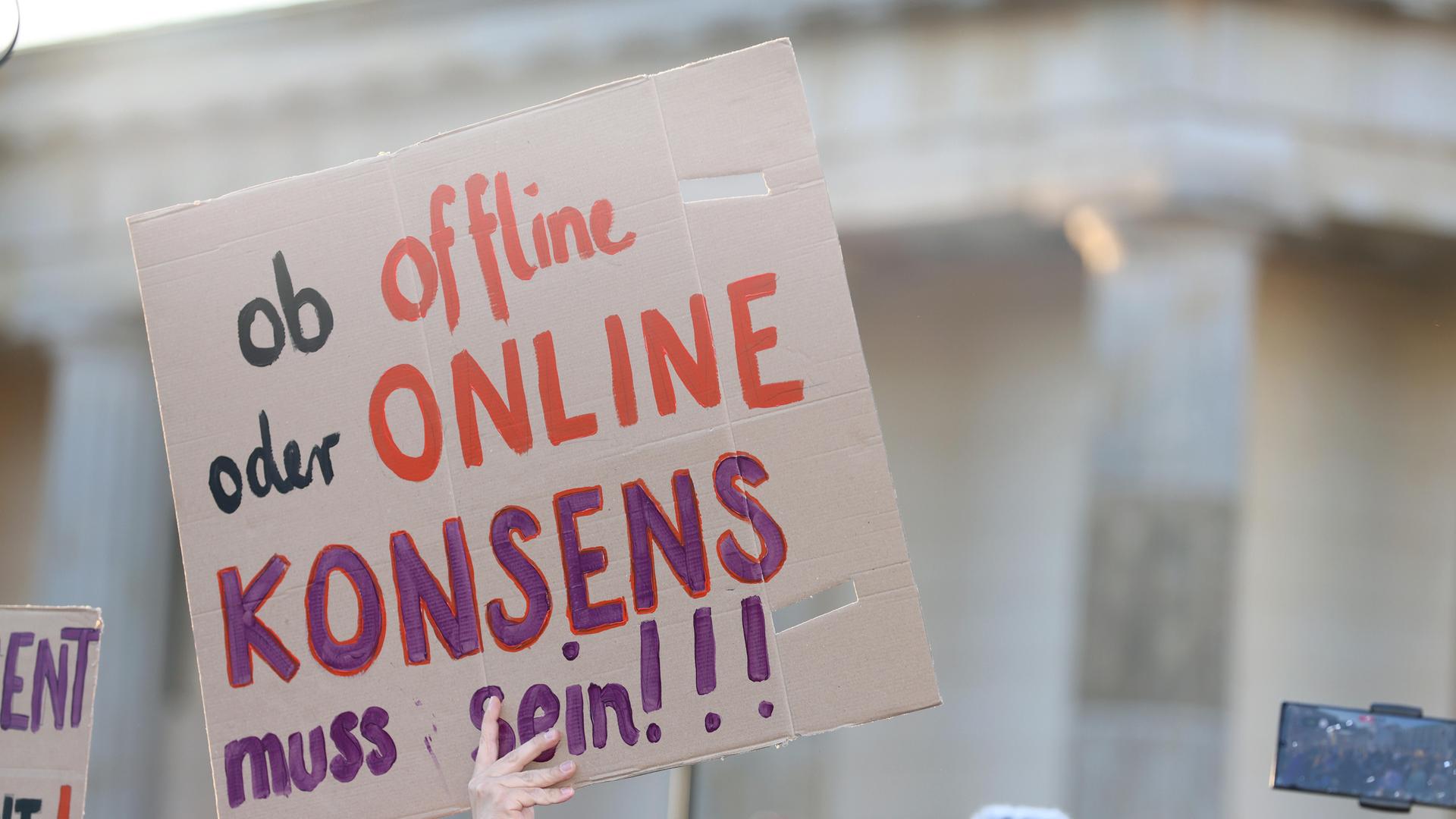

Für Datenschutzexperten und Bürgerrechtler ist biometrische Gesichtserkennung ein besonders tiefgreifender Eingriff in die Privatsphäre: Die Technologie ermögliche eine bislang beispiellose staatliche Überwachung im öffentlichen Raum. Sie befürchten, dass Menschen wegen Gesichtserkennung öffentliche Orte meiden könnten oder sich nicht mehr trauen zu demonstrieren.

Die Rechtsprofessorin Indra Spiecker genannt Döhmann von der Universität Köln kritisiert vor allem die zum Teil unklaren Definitionen und die fehlende Begrenzung staatlicher Zugriffe in den gesetzlichen Grundlagen. „Jetzt, heute, 2025, haben wir so viel informationelle Machtasymmetrien wie wahrscheinlich noch nie zuvor in der Geschichte der Menschheit.“ Gerade bei Gesichtserkennung seien die gesetzlichen Formulierungen aus ihrer Sicht nicht ausreichend konkret. Sie nennt ein Beispiel aus der Terrorabwehr: „Was ich zu einer Terroraktivität oder einer Gefahr, einem Risiko definiere als terroristische Aktivität, das ist sehr weit offen und da hat die Polizei in der Regel auch einen ganz weiten Einschätzungsspielraum.“

Es gehe in der Diskussion sehr um die Stärkung der Polizeiarbeit und darum, dafür mehr Daten zur Verfügung zu haben, sagt die Juristin. Was jedoch dabei aus dem Fokus gerate, sei, dass damit potenziell die Daten aller Bürger erfasst würden, „dass wir damit eine Situation schaffen der Totalüberwachung“, sagt Indra Spiecker genannt Döhmann.

Eric Töpfer vom Deutschen Institut für Menschenrechte warnt außerdem vor dem Aufbau immer größerer Datenmengen. Die Polizei verfüge bereits über einen Bestand von rund fünf Millionen Bildern. Wenn künftig auch öffentlich zugängliche Fotos aus dem Internet hinzukämen, ergäbe das eine „gigantische Lichtbild-Datenbank“. Problematisch sei dabei nicht nur die schiere Masse, sondern vor allem, „dass wir alle ja eigentlich keinen Anlass dafür geben, polizeilich erfasst zu werden, weil die meisten von uns sich nichts haben zu Schulden kommen lassen und wir dann plötzlich im polizeilichen Fahndungsbestand landen.“