3.100 Google-Mitarbeiter haben "Nein" gesagt. Sie forderten, dass Google keine Anwendungen Künstlicher Intelligenz mehr für Rüstungsprojekte entwickelt. Der Brief hatte Konsequenzen. Google beteiligt sich nicht an einem aktuell ausgeschriebenen milliardenschweren IT-Projekt des amerikanischen Verteidigungsministeriums. Ein Unternehmenssprecher von Google erläuterte die Entscheidung schriftlich so:

"Wir bieten nicht auf den JEDI-Vertrag, weil wir uns nicht sicher sein können, dass er mit unseren ethischen AI-Prinzipien übereinstimmt."

Diese ethischen Prinzipien für Künstliche Intelligenz hat Google-Chef Sundar Pichai persönlich in einem Blog-Post veröffentlicht. Unter anderem heißt es dort:

"Wir werden keine Künstliche Intelligenz entwerfen oder einsetzen in Waffen oder andere Technologien, deren Hauptzweck oder Implementierung darin besteht, Personen zu verletzen."

Ob Google diese Versprechen wirklich halten kann, ist fraglich. Denn jede Software, die für friedliche Zwecke entwickelt wurde, kann auch immer für militärische, für kriegerische Zwecke eingesetzt werden. "Dual Use" also.

"Wir bieten nicht auf den JEDI-Vertrag, weil wir uns nicht sicher sein können, dass er mit unseren ethischen AI-Prinzipien übereinstimmt."

Diese ethischen Prinzipien für Künstliche Intelligenz hat Google-Chef Sundar Pichai persönlich in einem Blog-Post veröffentlicht. Unter anderem heißt es dort:

"Wir werden keine Künstliche Intelligenz entwerfen oder einsetzen in Waffen oder andere Technologien, deren Hauptzweck oder Implementierung darin besteht, Personen zu verletzen."

Ob Google diese Versprechen wirklich halten kann, ist fraglich. Denn jede Software, die für friedliche Zwecke entwickelt wurde, kann auch immer für militärische, für kriegerische Zwecke eingesetzt werden. "Dual Use" also.

"Wir kriegen den Geist nicht wieder in die Flasche zurück"

Robert Joyce, Koordinator für Cybersicherheit im Weißen Haus und Sonderberater des amerikanischen Präsidenten Donald Trump, betont, dass jede technische Entwicklung mit dieser Dual-Use-Problematik zu kämpfen hat. In der Informationstechnik aber ist die Entwicklung dramatisch. Big-Data-Analyse können zum Beispiel dafür verwendet werden, die Stromversorgung stabiler und sicherer zu machen.

Wenn die Ausfallwahrscheinlichkeit eines Lastverteilungsrechners, eines Kondensators oder eines Umspannwerks einen kritischen Wert übersteigt, wird das Gerät ausgetauscht, bevor etwas passiert. Dieselben Big-Data-Algorithmen können aber auch dazu benutzt werden, um ein Land anzugreifen. Einem feindlichen Staat alle Lichter auszuknipsen. Robert Joyce:

"Wir kriegen den Geist nicht wieder in die Flasche zurück. Die Staaten bauen ihre digitalen Angriffsmöglichkeiten aus. Die Zahl der Staaten, die zugeben, dass sie staatliche Hacker einsetzen, wächst jedes Jahr. Den nachrichtendienstlichen Berichten zufolge verfügen mehr als 100 Staaten über digitale Waffen oder können Exploits entwickeln."

Mit Diagnosesystemen können Sicherheitslücken erkannt werden. Die können dann entweder geschlossen werden - oder Militärs und Geheimdienste bauen auf Basis dieser Sicherheitslücken digitale Waffen. Ein Programmierer kann kaum noch abschätzen, für welchen militärischen oder geheimdienstlichen Zweck seine Algorithmen oder seine Software später eigesetzt werden.

"Wir kriegen den Geist nicht wieder in die Flasche zurück. Die Staaten bauen ihre digitalen Angriffsmöglichkeiten aus. Die Zahl der Staaten, die zugeben, dass sie staatliche Hacker einsetzen, wächst jedes Jahr. Den nachrichtendienstlichen Berichten zufolge verfügen mehr als 100 Staaten über digitale Waffen oder können Exploits entwickeln."

Mit Diagnosesystemen können Sicherheitslücken erkannt werden. Die können dann entweder geschlossen werden - oder Militärs und Geheimdienste bauen auf Basis dieser Sicherheitslücken digitale Waffen. Ein Programmierer kann kaum noch abschätzen, für welchen militärischen oder geheimdienstlichen Zweck seine Algorithmen oder seine Software später eigesetzt werden.

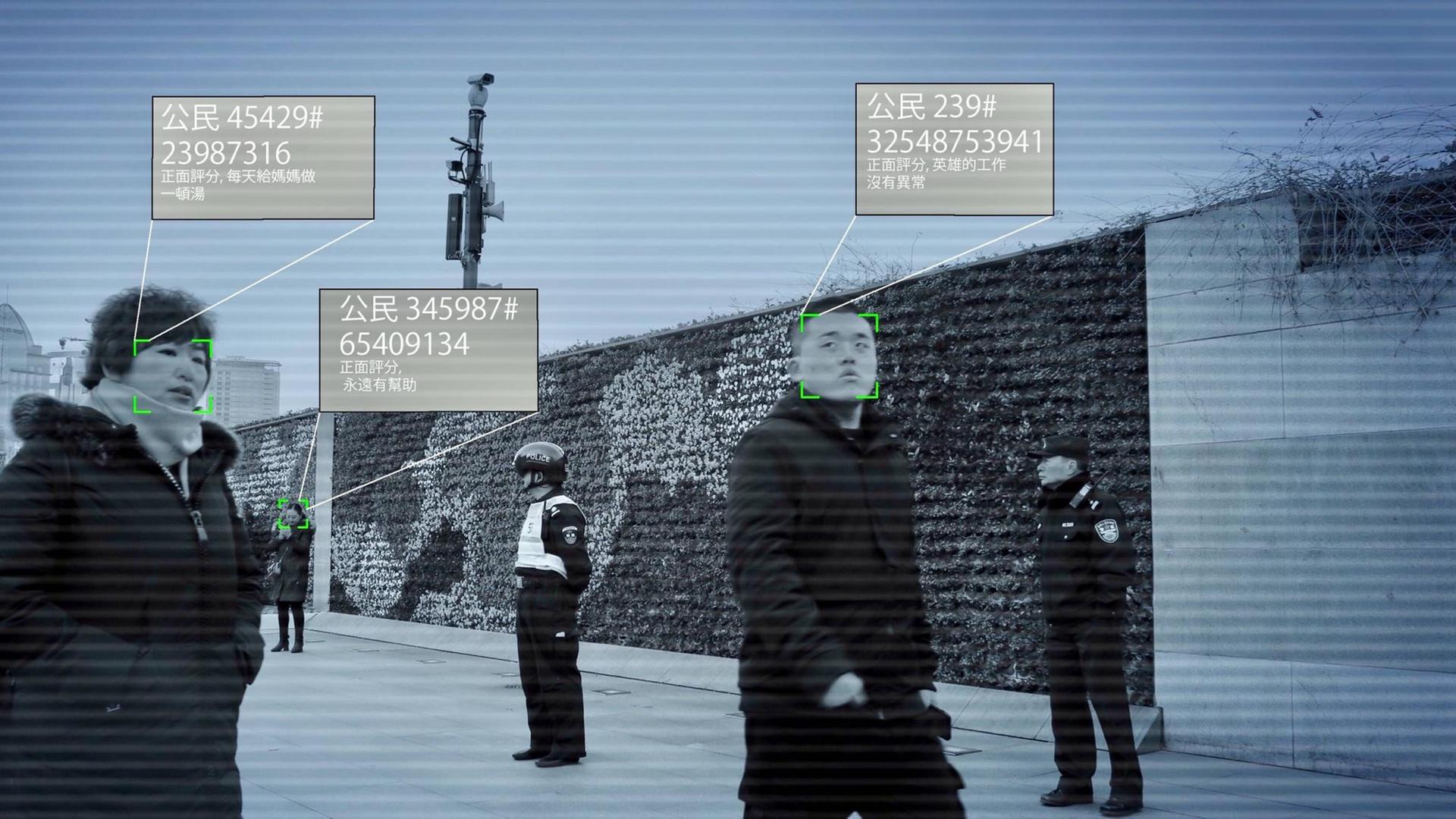

China nutzt Datenanalysen zur Überwachung

Ein Beispiel: Chinas Regierung nutzt für Überwachungszwecke Analyse-Algorithmen für Social-Media-Plattformen, die einmal dafür entwickelt wurden, um beginnende Epidemien oder Wirtschaftskrisen rechtzeitig zu erkennen. Professor Xueqi Cheng von der chinesischen Akademie der Wissenschaften:

"Um das menschliche Sozialverhalten zu messen, brauchen wir eine Datenanalyse. Sie gibt uns drei wertvolle Vorteile. Der erste liegt darin, zu verstehen, was in der Vergangenheit passiert ist. Der zweite darin, die Zukunft prognostizieren zu können. Was wird passieren, diese Frage beantworten wir mit Echtzeitdaten. Und daraus folgt der dritte Vorteil: Wir können beeinflussen, was geschehen wird."

Eine solche Datenanalyse kann für die bessere Planung von Infrastruktur, für einen effizienteren Personenfern- und Nahverkehr oder für eine rechtzeitige Krisenabwehr genutzt werden. Staaten könnten sie aber genauso gut nutzen, um Bürger lückenlos zu überwachen, um Spezialisten mit einem besonderen Verhaltensprofil für das Militär ausfindig zu machen, oder für die Planung militärischer Kommandounternehmen.

Unter Softwareentwicklern wächst deshalb insbesondere in Westeuropa die Unsicherheit: Welche ihrer Algorithmen und Tools lassen sich überhaupt noch auf friedliche, rein zivile und demokratisch-rechtsstaatliche Anwendungen beschränken? Technik sei neutral, wird immer wieder argumentiert. Aber wer entscheidet über ihren Einsatz, wenn die Entwickler von Informationstechnik das schon faktisch aus der Hand geben mussten und gegeben haben?

"Um das menschliche Sozialverhalten zu messen, brauchen wir eine Datenanalyse. Sie gibt uns drei wertvolle Vorteile. Der erste liegt darin, zu verstehen, was in der Vergangenheit passiert ist. Der zweite darin, die Zukunft prognostizieren zu können. Was wird passieren, diese Frage beantworten wir mit Echtzeitdaten. Und daraus folgt der dritte Vorteil: Wir können beeinflussen, was geschehen wird."

Eine solche Datenanalyse kann für die bessere Planung von Infrastruktur, für einen effizienteren Personenfern- und Nahverkehr oder für eine rechtzeitige Krisenabwehr genutzt werden. Staaten könnten sie aber genauso gut nutzen, um Bürger lückenlos zu überwachen, um Spezialisten mit einem besonderen Verhaltensprofil für das Militär ausfindig zu machen, oder für die Planung militärischer Kommandounternehmen.

Unter Softwareentwicklern wächst deshalb insbesondere in Westeuropa die Unsicherheit: Welche ihrer Algorithmen und Tools lassen sich überhaupt noch auf friedliche, rein zivile und demokratisch-rechtsstaatliche Anwendungen beschränken? Technik sei neutral, wird immer wieder argumentiert. Aber wer entscheidet über ihren Einsatz, wenn die Entwickler von Informationstechnik das schon faktisch aus der Hand geben mussten und gegeben haben?